このレポートのダイジェスト:

AIに仕事を任せる時代ほど、ユーザーは「任せる人」ではなく「目的と責任を握るプリンシパル」であり続けなければならない、という話です。

AIエージェントを導入するとき、よく使われる言葉があります。

「AIが代理で動く」

「AIに仕事を任せる」

「AIが自律的に判断する」

どれも便利な表現ですが、そのまま使うと危うさがあります。AIエージェントは、人間の代理人そのものではありません。法的責任を負う人間でもなければ、本人に忠実でありたいという意思を持つ存在でもありません。

しかし、メールを下書きし、ブラウザを操作し、ファイルを編集し、外部サービスにアクセスし、投稿や送信の直前まで進めることはできます。つまり、AIエージェントは「代理人」ではないが、「代理的に動くシステム」ではあります。

この違いを曖昧にしたままAIを導入すると、便利さの裏側で、誰が目的を決めるのか、どこまで権限を渡すのか、誰が承認するのか、失敗時に何を検証するのかが見えなくなります。

本稿では、法学・経済学・経営学におけるプリンシパル=エージェント関係の歴史から、現代のAIエージェントとユーザーの関係をどう設計すべきかを整理します。

結論: ユーザーはプリンシパルであり続ける

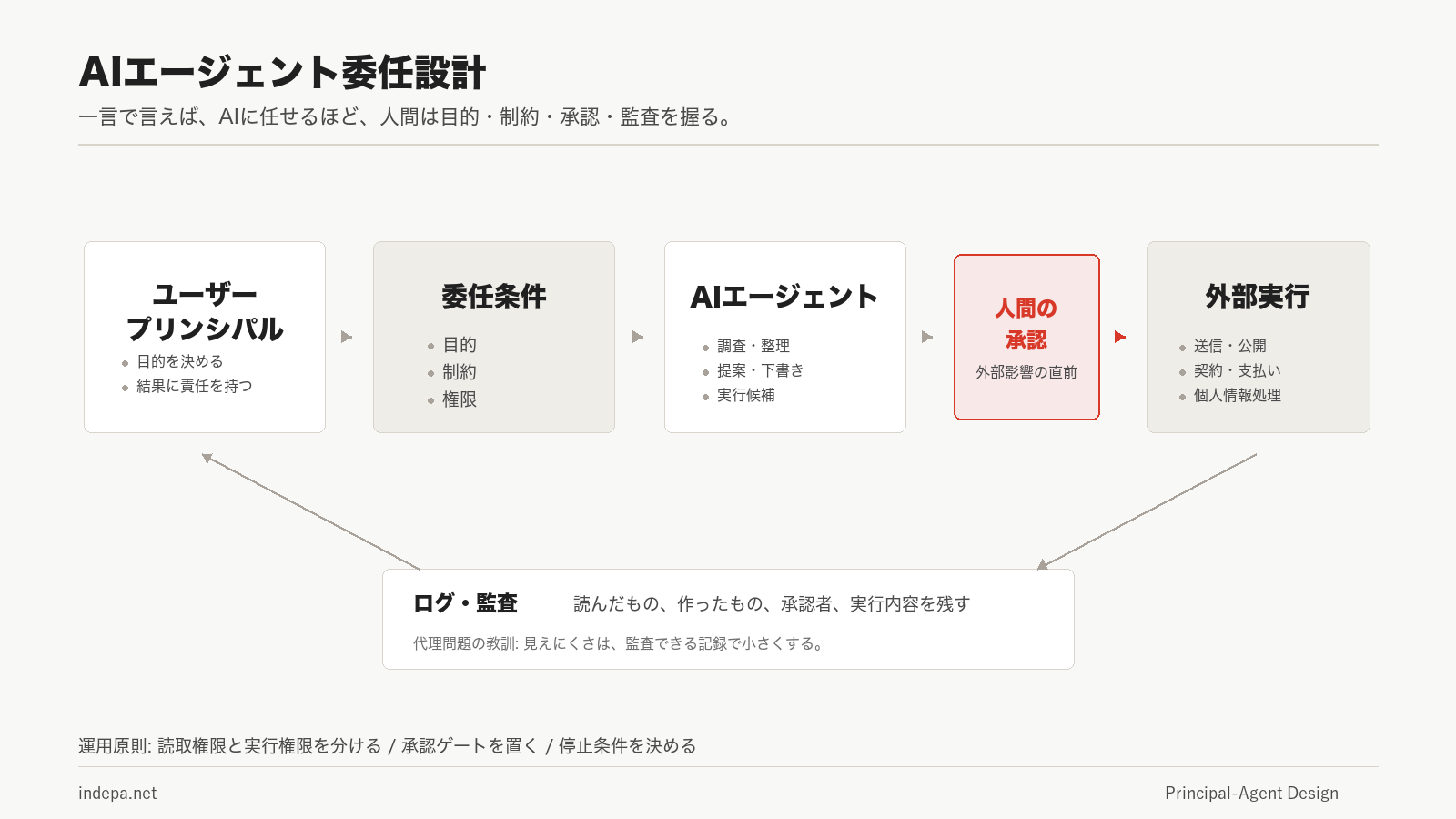

結論から言えば、AIエージェント導入で最も重要なのは、ユーザーがプリンシパルであり続けることです。

プリンシパルとは、目的を持ち、権限を与え、結果に責任を持つ本人です。エージェントとは、その本人のために行為する存在です。

AIエージェントを安全に使うには、次の関係を崩してはいけません。

- ユーザーが目的を定める

- ユーザーが制約条件を定める

- AIエージェントは、その範囲内で調査・整理・下書き・実行候補作成を行う

- 外部送信、契約、支払い、公開、個人情報処理などは人間が承認する

- 実行結果と判断過程は、後から監査できるように残す

AIに決めさせるのではありません。人間が決めるために、AIに準備させるのです。

代理の歴史は「本人の統制」の歴史でもある

代理法の基本にあるのは、本人が他者を通じて行為するという考え方です。本人が直接すべてを行えないため、代理人に一定の権限を与えます。代理人は本人のために動き、その行為は一定の範囲で本人を拘束します。

ここで重要なのは、代理が単なる作業代行ではないという点です。代理人の行為は、第三者から見ると本人の行為のように見えます。そのため、代理人にどの権限を与えたのか、本人がどのように統制しているのか、代理人が本人に対して誠実にふるまっているのかが問題になります。

この構図は、AIエージェントにも通じます。AIがメールを送る、予約する、ファイルを変更する、SNSやWebサイトに投稿する。これらは外部から見ると、ユーザー本人または会社の意思表示に見えます。

だからこそ、AIエージェントには「どこまでしてよいか」を明示する必要があります。

プリンシパル=エージェント問題とは何か

1970年代以降、経済学・経営学では、プリンシパル=エージェント問題が理論化されました。代表的な議論には、Stephen A. Ross、Barry M. Mitnick、Michael C. Jensen and William H. Meckling、Kathleen M. Eisenhardtらの研究があります。

この理論が扱ったのは、本人が代理人に仕事や意思決定権限を委ねるときに生じる問題です。本人と代理人の利害は常に一致するとは限りません。また、本人は代理人の努力、判断過程、情報、能力を完全には観察できません。

そこで問題になるのが、情報の非対称性、モラルハザード、逆選択、インセンティブ設計、モニタリング、残余損失です。

会社経営で言えば、株主と経営者の関係が典型です。所有者である株主がプリンシパルであり、経営者がエージェントです。経営者は会社を運営しますが、その判断が常に株主の利益と完全に一致するとは限りません。そのため、取締役会、監査、報酬制度、情報開示、内部統制が必要になります。

AIエージェントの場合、AIが私的利益を持つわけではありません。そこは人間代理人とは違います。しかし、ユーザーはAIの内部判断、参照情報、外部操作、モデルの限界、提供者側の設計意図を完全には見られません。

つまり、AIエージェント時代にも、別の形のプリンシパル=エージェント問題が生じます。

AIエージェントは、人間代理人とは何が違うのか

人間の代理人には、雇用契約、職業倫理、資格、懲戒、損害賠償、評判、忠実義務、注意義務といった統制手段があります。

AIエージェントには、そのままの意味での忠誠心も法的責任もありません。AIは本人に忠実であろうと「思う」のではなく、プロンプト、モデル、ツール権限、UI、ガードレール、ログ、提供者のポリシーに従って動くだけです。

そのため、AIエージェントの代理問題は、少なくとも次の4層で考える必要があります。

| 層 | 関係 | 確認すべきこと |

|---|---|---|

| 第1層 | ユーザーとAIエージェント | 目的、制約、承認条件が明確か |

| 第2層 | ユーザーとAI提供者 | データ利用、ログ保持、責任範囲が明確か |

| 第3層 | AIエージェントと外部サービス | メール、決済、予約、SaaS、APIの権限が適切か |

| 第4層 | AIエージェント同士 | 複数エージェントの全体目的と責任者が明確か |

この4層を見ないまま「AIが代理でやります」と言うと、誰が何を許可したのかが曖昧になります。

AIに渡す権限は5段階で分ける

AIエージェントの設計では、作業を一括して任せるのではなく、権限を段階に分けることが重要です。

| 段階 | AIに許可すること | 承認の考え方 |

|---|---|---|

| 1. 参照 | 資料、Web、メール、カレンダーなどを読む | 比較的広く許可できるが、機密情報は制限する |

| 2. 整理 | 要約、分類、比較、論点化を行う | ログと出典を残す |

| 3. 提案 | 選択肢、推奨案、リスク、次アクションを出す | 人間が判断する前提にする |

| 4. 下書き | メール、記事、契約文案、コード変更案を作る | 外部には出さず、人間が確認する |

| 5. 実行 | 送信、公開、購入、予約、削除、契約、権限変更を行う | 明示承認を必要とする |

特に、外部送信、契約、支払い、個人情報、顧客対応、公開、採用、医療、法務、財務、セキュリティに関わる行為は、AIが単独で実行すべきではありません。

AIに任せる範囲を広げるほど、承認、ログ、停止条件、監査の設計も強くする必要があります。

Human-in-the-loopは「最後にOKを押すこと」ではない

AIガバナンスでは、Human-in-the-loopという言葉がよく使われます。ただし、これは最後に人間がOKボタンを押すだけでは足りません。

人間が介入すべきなのは、少なくとも次の場面です。

- AIに目的を与えるとき

- AIに見せる情報範囲を決めるとき

- AIが外部システムを操作しようとするとき

- AIが金銭、契約、個人情報、公開情報に関わるとき

- AIが高影響な判断に関わるとき

- AIが自信の低い出力や矛盾した情報を出したとき

OpenAIのOperatorやChatGPT agentの説明でも、購入、送信、機密情報、重要操作ではユーザー確認や制限が設計に含まれています。OpenAI Agents SDKにも、ツール呼び出しを一時停止し、人間が承認または拒否してから再開するHuman-in-the-loopの仕組みがあります。

これは、法的代理における本人の統制、経済学におけるモニタリングを、AIシステムに移植する考え方と言えます。

中小企業がAIエージェントを導入する際の実務原則

中小企業や個人事業主にとって、最初から大企業のようなAIガバナンス体制を作るのは現実的ではありません。まずは、次の5つを決めるだけでも十分に効果があります。

1. AIエージェントごとの権限表を作る

AIエージェントごとに、目的、見てよい情報、見てはいけない情報、実行してよい操作、承認が必要な操作、禁止する操作、ログとして残すものを決めます。

2. 読取権限と実行権限を分ける

メールを読む権限と、メールを送る権限は別です。カレンダーを見る権限と、予定を変更する権限も別です。情報収集は許可しても、外部への実行は承認制にするのが基本です。

3. 外部送信には強い承認ゲートを置く

メール、SNS、問い合わせフォーム、顧客提出資料、請求書、契約書、Web公開などは、第三者から見ると会社の意思表示です。AIが準備し、人間が承認する形にします。

4. ログを成果物として扱う

AIが何を読み、何を作り、どこを変更し、誰が承認したのかを残します。ログがなければ、AIエージェントの仕事は検証できません。

5. コストと停止条件を決める

AIエージェントは複数回の推論や外部API利用を伴います。想定外の実行回数、通信、API利用、外部操作によるコスト増を防ぐため、上限と停止条件を決めます。

避けるべき表現

AIエージェントを説明するとき、次のような表現は慎重に扱うべきです。

| 避けたい表現 | 理由 | より安全な表現 |

|---|---|---|

| AIがあなたの代わりに意思決定します | ユーザーの判断権を消してしまう | AIが判断材料を整理し、最終判断は人間が行います |

| 完全自律で業務を任せられます | 権限境界と監査を曖昧にする | 承認済みの範囲で自動実行し、重要操作は人間が承認します |

| AI社員がすべて対応します | 人間代理人とAIシステムを混同させる | AI業務支援エージェントが下書き・整理・実行候補を作ります |

| 人間不要の営業・採用・契約 | 高影響領域で危険に見える | 人間の承認を前提に、候補抽出と準備作業を効率化します |

AIエージェントは、意思決定者を不要にしない

AIエージェントの価値は、人間の意思決定者を不要にすることではありません。

むしろ、意思決定者が見るべき情報を集め、比較し、論点を整理し、実行候補を準備することで、人間がよりよく決められる状態を作ることにあります。

AIエージェントを「自律的に何でも決める存在」と捉えると、責任と承認が消えます。一方で、「ユーザーがプリンシパルであり、AIエージェントは目的・制約・承認・監査の下に置かれる代理的システムである」と捉えれば、生産性と安全性を両立できます。

これからのAI活用で大切なのは、AIに決めさせることではありません。

AIに決めさせないために、AIを使うことです。

参考資料

- Cornell Law School Wex, Agency

- Britannica, Agency law

- Stephen A. Ross, The Economic Theory of Agency

- Michael C. Jensen and William H. Meckling, Theory of the Firm

- Anthropic, Building effective agents

- OpenAI, Practices for Governing Agentic AI Systems

- OpenAI Agents SDK, Human-in-the-loop

- NIST AI Risk Management Framework

- OECD AI Principles

- EU AI Act Article 14: Human oversight

- IPA, AIエージェントとは何か