人間の労働の代替、という見立てはどこまで正しいか

AIエージェントを一言で表し、「人間の労働の代替」という捉え方がされることがある。これはかなり本質を突いている。

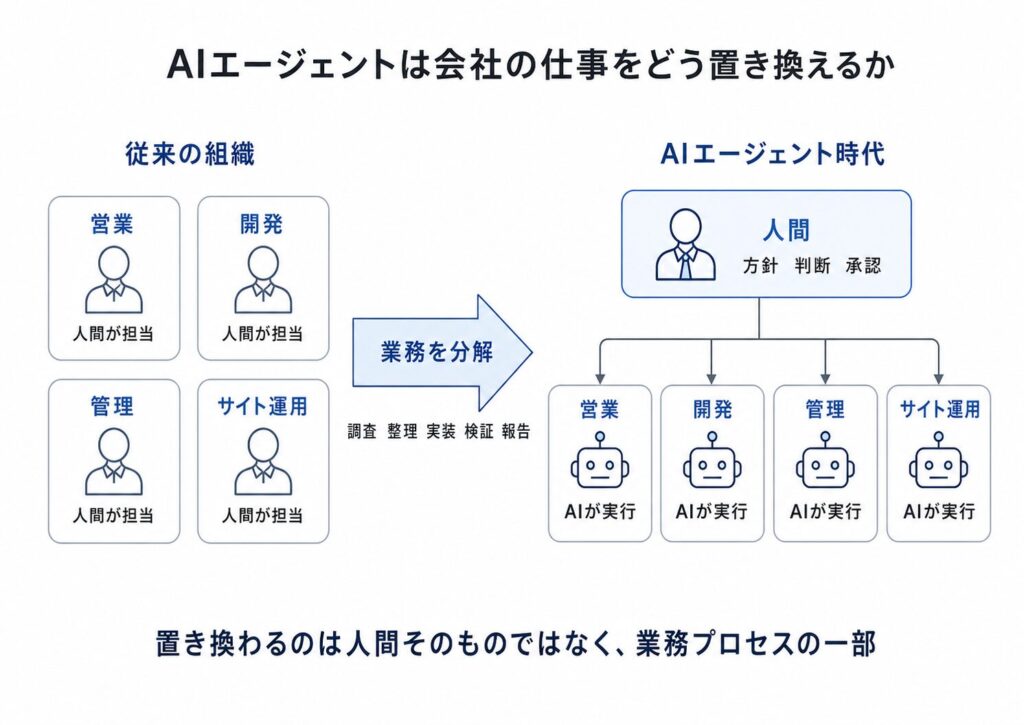

ただし、より正確に言えば、代替されるのは「人間そのもの」ではなく、「人間が担っていた業務プロセスの一部」となるだろう。

これまで会社の組織図では、営業、開発、制作、管理、経理、人事、広報といった部署ごとに人間が配置されていた。AIエージェントの登場によって、この組織図の各ノードに「人間だけ」を置く必要は薄れていく。あるノードでは人間が判断を担い、AIが調査、整理、実装、検証、報告を担う。さらに成熟すれば、一部のノードではAIエージェントが主担当となり、人間は監督者、承認者、設計者に回る。

この変化は既に始まっている。McKinseyの2025年調査では、回答企業の88%が少なくとも一つの業務機能でAIを定常利用しており、23%が企業内のどこかでエージェント型AIをスケールさせ、39%が実験を始めている。ただし、機能別に見ると、AIエージェントをスケールさせている割合はどの業務機能でも10%以下にとどまる。つまり、普及は進んでいるが、部署丸ごとの置換にはまだ至っていない。(McKinsey & Company)

結論を先に言えば、2026年5月時点でAIエージェントに任せやすいのは、成果物が明確で、検証でき、やり直し可能な業務である。自社サイト管理、コード修正、記事下書き、SEOメタ情報作成、レポート作成、定期調査、問い合わせ分類、ドキュメント整理などは相性が良い。一方で、採用判断、解雇、法的判断、経営責任を伴う意思決定、顧客との重大交渉、資金移動などは、人間の承認を外すべきではない。

AIエージェントとは何か

本稿では、AIエージェントを次のように定義する。

AIエージェントとは、目的を与えられると、情報を読み、手順を考え、外部ツールを操作し、成果物を作り、必要に応じて人間に確認を求めるAIシステムである。

McKinseyは、AIエージェントを「基盤モデルをもとに、現実世界で行動し、ワークフロー内で複数ステップを計画し実行できるシステム」と説明している。これは従来のチャットAIとは異なる。チャットAIは主に回答を返す。AIエージェントは、回答に加えて、ファイルを編集し、コードを変更し、表を作り、ブラウザを操作し、スケジュールされた作業を実行する。(McKinsey & Company)

Claude Coworkは、非エンジニア向けの知識労働エージェントに近い。Anthropicの説明では、Coworkはチャットとは異なり、ユーザーが成果物と実行頻度を指定すると、Claudeが自律的に作業し、進行状況を知らせる。例として、スケジュールされたタスク、ファイル整理、スプレッドシート作成、レポート準備、ノート分析などが挙げられている。(Claude)

Claude Codeは、開発領域に特化したエージェントである。公式ドキュメントでは、コードベースを読み、ファイルを編集し、コマンドを実行し、開発ツールと連携するエージェント型コーディングツールと説明されている。Enterprise版では、コードの作成、デバッグ、リファクタリング、テスト作成、PR作成、コードレビュー、組織標準に沿ったチェックなどが想定されている。(Claude)

Codex appも同じ方向にある。OpenAIはCodexを、ChatGPTによるコーディングエージェントと位置づけており、機能構築、複雑なリファクタリング、移行、PR、コードレビュー、ドキュメント化、定期的なissue分類、アラート監視、CI/CD関連作業などに使えるとしている。Codex appは、複数のエージェントを並列に動かすためのコマンドセンターとして設計されている。(OpenAI)

会社の組織図は、人間の配置図から、業務処理ネットワークへ変わる

従来の会社では、組織図の各ノードには人間が配置されていた。営業には営業担当、開発にはエンジニア、制作には編集者、管理には事務担当がいた。

AIエージェント時代には、この見方を少し変える必要がある。組織図のノードは「人間の席」ではなく、「業務処理の単位」になる。

たとえば、自社サイト運用というノードを考える。このノードには、記事公開、リライト、画像差し替え、内部リンク確認、表示崩れ修正、アクセス解析、SEO改善、問い合わせ導線改善、CMS更新、コード修正などが含まれる。これらを一人の担当者が抱えるのではなく、タスクごとにAIエージェントへ分配する。人間は全体方針、優先順位、公開承認、ブランド判断、リスク判断を担う。

この時点で、仕事の主語が変わる。「私が全部やる」から「私はAIエージェント群を使って成果物を出す」へ変わる。Microsoftの2025 Work Trend Indexでも、AIを組織全体に展開し、エージェント活用が進んだ企業を「フロンティア組織」として扱い、人とAIエージェントのチーム、そして「エージェントボス」という新しい役割を示している。日本語版の要約では、リーダーの82%、日本では75%が、2025年を戦略と運営の核心を再考する重要な年と見ているとされる。(Source)

ただし、ここで重要なのは、AIエージェントは万能の社員ではないという点である。現時点では、AIは「成果基準が明確な業務」では強いが、「責任の所在が曖昧な業務」では危険になる。

どの業務をどこまで任せられるか

以下は、2026年5月時点の実務感に基づく推定である。確率は、一般的な中小企業、ウェブ運用、コンテンツ制作、軽度から中度の開発業務を想定した主観推定である。

| 業務領域 | AIエージェントに任せられる範囲 | 現時点の委任可能性 |

|---|---|---|

| 自社サイトの記事下書き | 構成案、初稿、要約、FAQ、タイトル案、メタディスクリプション | 85% |

| 既存記事の改善 | 誤字修正、見出し再編、内部リンク候補、SEO観点の改善案 | 80% |

| サイト管理 | 画像差し替え、軽微なCMS更新、リンク切れ確認、定期レポート | 65% |

| フロントエンド修正 | 表示崩れ、軽微なUI変更、CSS修正、テスト追加 | 60% |

| バックエンド実装 | 小規模機能、既存仕様に沿う修正、移行補助、リファクタリング | 50% |

| コードレビュー | PR要約、リスク指摘、テスト不足指摘、規約違反検出 | 70% |

| アクセス解析 | GA4やSearch Consoleの数値整理、仮説出し、改善案 | 75% |

| 顧客対応 | 問い合わせ分類、返信下書き、FAQ候補作成 | 70% |

| 経理、法務、人事 | 書類整理、要約、一次チェック、論点抽出 | 40% |

| 経営判断 | 調査、選択肢整理、シナリオ分析、会議資料化 | 35% |

| 最終意思決定 | 採用、契約、公開、支払い、法的判断、ブランド毀損リスク判断 | 10% |

この表から分かる通り、AIエージェントに任せやすい業務には共通点がある。入力が明確で、出力形式が定義でき、成功基準を検査でき、失敗しても戻せる業務である。

逆に、AIエージェントに任せにくい業務には、不可逆性、対人責任、法的責任、ブランド責任、倫理判断が絡む。

「労働の代替」は現実化するが、「仕事の消滅」とは同じではない

AIが人間の仕事を奪うという言い方は粗い。より正確には、人間の仕事の中に含まれていた「反復可能な作業単位」が先に置換される。

Anthropic Economic Indexの2026年1月版では、Claudeの利用は3,000以上の作業タスクに広がっている一方、上位10タスクが会話の24%を占め、利用は特定タスクに集中しているとされる。特にソフトウェア修正は大きな割合を占め、Claude.aiではコンピュータ関連タスクが全体の34%、API利用では46%を占める。さらにAPI利用は自動化寄りで、オフィス管理系タスクの利用増加も見られる。(Anthropic)

つまり、AIエージェントの進化は「全職業を一気に置換する」形ではなく、「特定の高頻度タスクを深く置換する」形で進んでいる。

労働市場全体で見ると、2026年3月のAnthropicの分析では、AIに高くさらされている職種で、2022年末以降に体系的な失業増加は確認されていない。一方で、22歳から25歳の若年層については、AIにさらされやすい職種への採用がやや鈍っている可能性が示唆されている。これは「今いる人が一斉に解雇される」よりも、「新しく採られにくくなる」形で影響が出る可能性を示す。(Anthropic)

したがって、会社にとっての現実的な問いは、「AIで人間が不要になるか」ではない。「新しく人を採る前に、AIエージェントでその業務を処理できないか」である。

この問いは、すでに経営判断として現実的になっている。

エージェント化の限界は、長い仕事、曖昧な仕事、検証困難な仕事にある

AIエージェントの能力は急速に伸びている。METRは、AIエージェントが一定の信頼性で完了できるタスクの長さを「タスク完了タイムホライズン」として測定している。2026年4月15日更新の説明では、50%タイムホライズンは、人間専門家がその時間をかけるタスクをAIが半分の確率で完了できる長さとして定義される。(Metr)

METRの2025年研究では、このタイムホライズンが過去6年でおおむね7か月ごとに倍増していると報告された。ただし同じ研究は、当時の最良モデルでも日常業務をそのまま人間の代替として安定遂行できる段階ではなく、低スキルのリモート秘書業務でさえ信頼性に限界があると述べている。(Metr)

ここが重要である。AIエージェントは短い仕事には強い。数分から数十分のまとまった作業は急速に任せやすくなっている。一方で、数日から数週間にわたる曖昧なプロジェクト、関係者調整、方針変更、例外処理、責任判断を含む仕事は、まだ人間の設計と監督が必要である。

また、AI開発支援の効果も単純ではない。METRの2025年のランダム化比較試験では、経験豊富なオープンソース開発者が自身の熟知したリポジトリで作業した場合、AIツール使用時のほうが19%時間が長くかかった。ただし、2026年2月の追跡報告では、後期2025年のツールでは速度向上の兆候もあり、研究設計上の選抜バイアスが大きくなっていると説明されている。(Metr)

この結果から言えるのは、「AIを使えば必ず速くなる」ではない。「AIに向いたタスク選定と運用設計ができる会社ほど速くなる」である。

自社サイト管理は、AIエージェント導入の最適な実験場である

自社サイト管理は、AIエージェントの実験対象としてかなり良い。理由は三つある。

第一に、成果物が見える。記事、ページ、コード、画像、リンク、フォーム、レポートという形で、アウトプットが確認できる。

第二に、検証しやすい。表示確認、リンクチェック、テスト、アクセス解析、検索順位、CV率、問い合わせ数などで成果を測れる。

第三に、やり直しやすい。Git、CMS履歴、バックアップ、ステージング環境を用意すれば、多くの失敗は戻せる。

Claude CodeやCodex appは、コードベース理解、修正、テスト、PR、コードレビューに強い。Claude Coworkは、資料化、調査、ファイル整理、レポート作成、定期タスクに強い。自社サイト管理では、この二種類のエージェントを組み合わせやすい。

実務上は、次のような役割分担が適している。

| 役割 | 主担当 | 内容 |

|---|---|---|

| 方針決定 | 人間 | 何を改善するか、なぜ改善するかを決める |

| 調査 | Claude Cowork | 競合調査、既存記事分析、Search Console要約 |

| 実装 | Claude Code、Codex app | コード修正、CMS関連作業、UI修正、テスト |

| 検証 | AIと人間 | 表示確認、テスト結果、差分確認 |

| 公開承認 | 人間 | ブランド、法務、事業判断を含む最終確認 |

| 定期運用 | AIエージェント | 週次レポート、リンク確認、改善候補抽出 |

この形にすると、AIエージェントは「便利なチャット相手」ではなく、「業務を持つ作業者」になる。

導入で失敗しやすい会社の特徴

AIエージェント導入で失敗しやすい会社には共通点がある。

一つ目は、いきなり大きな仕事を渡すこと。たとえば「自社サイトを全部改善して」と依頼しても、判断基準、優先順位、制約条件が曖昧なら、成果は散らばる。

二つ目は、人間のレビュー負荷を計算していないこと。AIが大量に成果物を作るほど、人間は確認に追われる。レビュー設計がなければ、AI導入は省力化ではなく、確認作業の増加になる。

三つ目は、権限を広く渡しすぎること。AIエージェントはファイル編集、コマンド実行、ブラウザ操作、外部連携を行うため、権限設計を誤ると事故が起きる。OWASPは、エージェント型AIについて、自律性と生成AIの統合により能力とリスクが拡大しているとして、脅威モデルと緩和策の整備を進めている。NISTもAI Risk Management Frameworkで、AI製品やサービスの設計、開発、利用、評価に信頼性の観点を組み込むことを目的としており、生成AI固有のリスク管理プロファイルも公開している。(OWASP Gen AI Security Project)

四つ目は、AIを「社員の代わり」と見すぎること。AIは疲れないが、責任を取らない。AIは大量に案を出せるが、会社の価値判断はしない。AIはもっともらしい成果物を作れるが、その成果物が本当に会社の文脈に合っているかは、人間が見る必要がある。

安全に任せるための運用ルール

AIエージェントに業務を任せる際は、最低限、次のルールが必要である。

| 項目 | 実務ルール |

|---|---|

| 権限 | 最小権限にする。必要なフォルダ、必要なツールだけ許可する |

| 環境 | 本番ではなく、ローカル、ステージング、ブランチ上で作業させる |

| 承認 | 削除、公開、送信、支払い、契約、個人情報処理は人間承認を必須にする |

| ログ | 何を読み、何を変更し、どの判断をしたか記録する |

| 評価 | 作業時間、レビュー時間、差し戻し率、バグ率、CV改善を測る |

| データ | 商用プランのデータ利用条件を確認する |

| 撤退条件 | AIで遅くなる業務は、いったん人間主導に戻す |

Claude Codeは、標準では読み取り専用権限を使い、ファイル編集やコマンド実行など追加操作には明示的な許可を求める設計を説明している。また、サンドボックス化、書き込み範囲制限などの安全策も用意されている。(Claude)

OpenAIは企業向けプライバシーに関して、ChatGPT Business、Enterprise、API Platformなどのビジネスデータをデフォルトでモデル学習に使わないこと、入力と出力の管理権を顧客側に置くこと、SAML SSOや細かなアクセス制御を提供することを説明している。Anthropicも商用製品やAPIでは、デフォルトで入力や出力をモデル学習に使わないと説明している。(OpenAI)

このあたりは、AIエージェントを本格導入する会社にとって、単なる利用規約確認ではない。組織の情報管理、監査、顧客データ保護に直結する。

導入ロードマップ

AIエージェントを会社に導入するなら、いきなり全社導入ではなく、次の順番がよい。

| 段階 | 目的 | 具体例 | 成功条件 |

|---|---|---|---|

| 第1段階 | 個人作業の補助 | 記事案、コード修正案、調査要約 | 人間の作業時間が20%以上減る |

| 第2段階 | 定型業務の半自動化 | 週次レポート、リンク確認、PR要約 | 差し戻し率が低く、継続利用できる |

| 第3段階 | 小さな業務単位の委任 | LP修正、FAQ更新、軽微な機能追加 | 人間はレビューと承認に集中できる |

| 第4段階 | 複数エージェント運用 | 調査担当、実装担当、レビュー担当を分ける | 並列処理で納期が短くなる |

| 第5段階 | 組織ノードの再設計 | サイト運用、CS一次対応、社内ナレッジ管理 | 人員計画にAI前提の設計が入る |

最初の対象は、自社サイト管理が適している。次に、社内ナレッジ管理、問い合わせ対応、定期レポート、営業資料作成へ広げる。最後に、採用、法務、経理、経営企画の補助へ進める。ただし、後半の領域では人間承認を外さない。

今後二年の見通し

私の推定では、2026年から2028年にかけて、AIエージェントの影響は次のように進む。

| 見通し | 確率 |

|---|---|

| 自社サイト運用の定型作業の半分以上をAIエージェントで処理する会社が増える | 80% |

| 小規模企業で、採用せずにAIエージェントで一人分のバックオフィス作業を吸収する事例が一般化する | 65% |

| エンジニアが一人で複数のAIコーディングエージェントを動かす働き方が標準化する | 75% |

| 若手の入口業務が減り、未経験者が実務経験を積みにくくなる | 60% |

| 部署単位でAIが人間を完全置換する | 25% |

| 経営判断までAIに任せる会社が増えるが、事故も増える | 55% |

この予測の中心は、「人間がゼロになる」ではない。「少人数で回せる業務範囲が広がる」である。

会社にとっては、採用、外注、内製、AIエージェントの四つを比較して、どの業務を誰に任せるかを再設計する時期に入っている。

まとめ

AIエージェントは、人間の労働を代替し始めている。ただし、代替の単位は「人間」ではなく「業務」である。

組織図の各ノードをAIに置き換えるという見方は、方向性としては正しい。ただし、現実には、まずノード内の細かい作業が置き換わる。調査、整理、実装、検証、報告といった作業がAIに移り、人間は目的設定、判断、承認、責任、例外処理を担う。

Claude Cowork、Claude Code、Codex appのようなエージェントは、既に「使えるかどうか」を検討する段階を過ぎ、「どの業務をどの権限で任せるか」を設計する段階に入っている。

これからの会社に必要なのは、AIを使える人ではない。AIエージェントに仕事を分解し、権限を与え、成果を検証し、組織の生産性に変換できる人である。

その意味で、AIエージェントの本質は「人間の労働の代替」である。ただし最終的に代替されるのは、作業そのものではなく、従来の組織設計である。