組織導入と持続的イノベーションのための戦略的ブループリント

序論:AI時代の羅針盤としてのAIガバナンス

人工知能(AI)、特に生成AIの急速な進化は、産業構造や社会システムを根底から変革する潜在能力を秘めている。この技術革新の波は、企業にとって生産性向上、新サービス創出、そして競争優位性確立のまたとない機会を提供する一方で、倫理、プライバシー、公平性、セキュリティといった多岐にわたる複雑なリスクを顕在化させている。AIの判断がもたらす予期せぬ差別、機密情報の漏洩、あるいは誤情報(ハルシネーション)による信用の失墜など、その影響は事業の根幹を揺るがしかねない。

このような状況下で、AIガバナンスは単なるコンプライアンス遵守やリスク管理の枠組みを超え、AI時代を航海するための不可欠な「羅針盤」としての役割を担う。AIガバナンスとは、組織が掲げる価値観や原則に沿ってAIの研究、開発、応用を統率するための一連の組織体制、ルール、標準を確立する活動である 1。それは、AIがもたらす便益を最大化すると同時に、潜在的なリスクをステークホルダーにとって受容可能な水準に管理するための、技術的、組織的、そして社会的なシステムの設計と運用そのものである 2。

この課題の重要性は、一企業や一国家に留まるものではない。2023年のG7広島サミットで立ち上げられた「広島AIプロセス」が示すように、AI、とりわけ生成AIの安全性と信頼性を確保するためのガバナンス構築は、世界共通の喫緊の課題として認識されている 4。国際的なルール形成の議論が加速する中、企業はもはやAIの利便性のみを追求することは許されず、その社会的責任を全うすることが強く求められている。

本レポートは、AIの組織導入を目指す経営層および意思決定者に対し、AIガバナンスを戦略的資産として位置づけ、企業価値向上に繋げるための包括的なブループリントを提示するものである。AIガバナンスの基本概念から、その中核をなす原則、日本政府が示すフレームワーク、具体的な構築ロードマップ、そして先進企業の事例に至るまでを網羅的に解説する。本レポートを通じて、AIガバナンスが、リスクを回避するための「守り」の盾であると同時に、信頼を基盤としたイノベーションを加速させる「攻め」の剣であることを明らかにしたい。

第1章:AIガバナンスの定義と戦略的重要性

AIガバナンスの構築は、現代企業が直面する最も重要な経営課題の一つである。それは単なる技術的な管理体制の整備に留まらず、企業の社会的責任、ブランド価値、そして持続的な成長を左右する戦略的基盤となる。本章では、AIガバナンスの包括的な定義を明確にし、その導入がなぜ不可欠であるのか、そしてそれが如何にして企業価値の向上に貢献するのかを多角的に論じる。

1.1 AIガバナンスの包括的定義

AIガバナンスは、複数の公的機関によって定義されているが、その核心は共通している。経済産業省は、AIガバナンスを「AIの利活用によって生じるリスクをステークホルダーにとって受容可能な水準で管理しつつ、そこからもたらされる正のインパクト(便益)を最大化することを目的とする、ステークホルダーによる技術的、組織的、及び社会的システムの設計並びに運用」と定義している 3。また、総務省はより具体的に、「AIを利活用したシステム・サービスを企画、開発、導入、運用するに当たって、法制度や社会規範を遵守するとともに、AIに関するリスク等を適切にマネジメントするための体制構築と仕組み作り、その実行」と説明している 4。

これらの定義を統合し、実務的な観点からAIガバナンスを包括的に捉えると、それは「組織の理念と倫理原則に基づき、AIのライフサイクル(企画、開発、導入、運用、廃棄)全体にわたって、その便益を最大化し、潜在的リスクを最小化するための一連の原則、方針、組織体制、プロセス、そして技術的統制の体系」と言うことができる。

この体系は、AIが活用するデータの適切な取得と管理、アルゴリズムに潜むバイアスの制御、そしてAIが個人や社会に与える影響の評価といった具体的な活動を含む 5。最終的な目的は、倫理基準や社会の期待に沿ってAIが利用され、潜在的な悪影響を及ぼさないように必要な監督が行われることを保証することにある 6。

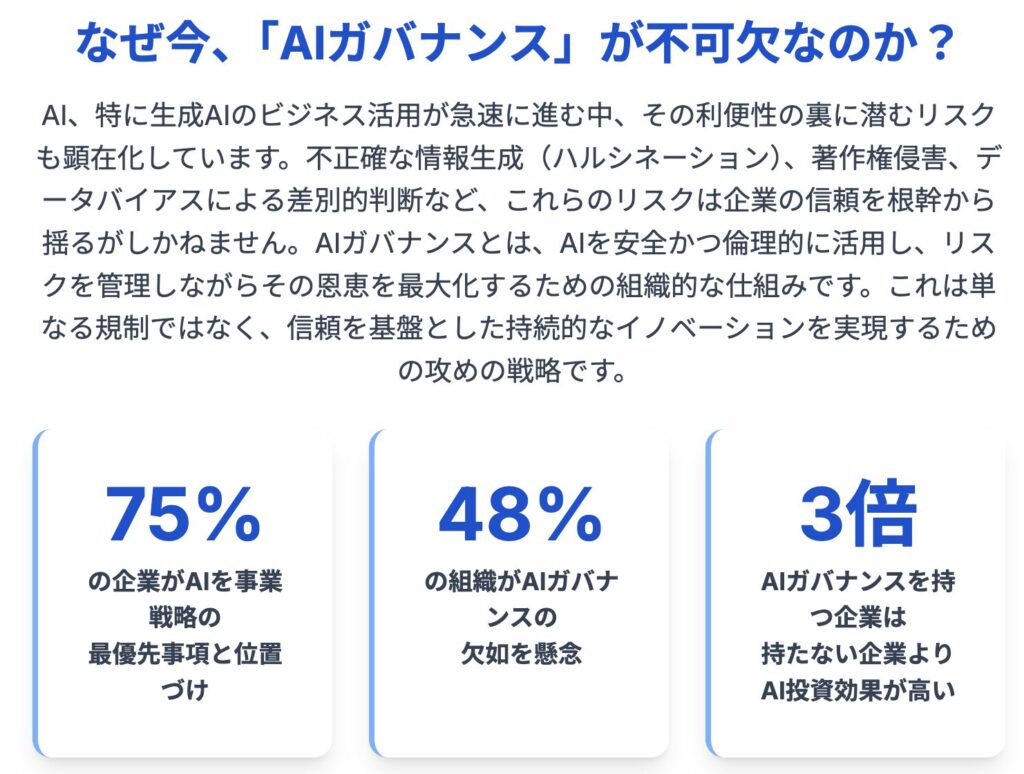

1.2 なぜ今、AIガバナンスが不可欠なのか

AI技術、特に生成AIの普及が加速する現代において、AIガバナンスの重要性はかつてないほど高まっている。その背景には、AIがもたらすリスクの多様化と深刻化がある。

第一に、内在するリスクの管理が挙げられる。AIモデル、特に深層学習に基づくモデルは、その学習データに存在する社会的なバイアス(人種、性別など)を増幅させる傾向がある 6。これにより、採用選考や融資審査といった重要な意思決定において、不公平で差別的な結果を生み出す危険性がある 7。また、AIの判断プロセスが不透明な「ブラックボックス」と化し、なぜその結論に至ったのかを説明できない場合、企業の倫理観が問われ、ステークホルダーからの信頼を失うことになる 7。

第二に、新たなリスクへの対応が急務となっている。生成AIの登場により、企業はこれまで以上に深刻なリスクに直面している。従業員が機密情報やソースコードを安易にAIに入力し、それが外部に漏洩するインシデントは後を絶たない 8。AIが生成したコンテンツが他者の著作権を侵害する可能性や、事実に基づかない情報(ハルシネーション)を生成し、それがビジネス上の誤判断や顧客への誤情報提供に繋がり、訴訟に発展するケースも報告されている 8。

第三に、法的・規制環境の変化への適応が求められる。欧州(EU)のAI規制法をはじめ、世界各国でAIに関する法規制の整備が進んでいる 7。グローバルに事業を展開する企業にとって、各国の法規制やガイドラインを遵守することは必須であり、違反した場合には多額の制裁金や事業停止命令といった厳しい措置が科される可能性がある。こうした規制は常に変化しており、企業は最新の動向を注視し、自社のガバナンス体制を継続的に見直す必要がある 6。

これらのリスクを放置すれば、財務的損失、法的責任、そして何よりも回復が困難なブランドイメージの毀損といった深刻なダメージに繋がりかねない 6。AIガバナンスは、これらの事故やトラブルを未然に防ぎ、社会からの信頼を維持するための重要な基盤なのである 8。

1.3 守りから攻めへ:企業価値向上に繋がるAIガバナンス

AIガバナンスは、リスクを管理する「守り」の側面だけでなく、企業価値を積極的に向上させる「攻め」の側面を併せ持つ。当初、多くの組織はガバナンスをコンプライアンス遵守のためのコストと捉えがちだが、成熟した組織はそれを戦略的投資と位置づけ、競争優位性の源泉へと転換している。

まず、イノベーションの加速と品質向上に直結する。組織全体で共通のルールやガイドラインを整備することで、開発プロセスの属人化を防ぎ、AIの品質を一定水準以上に保つことが可能になる 11。これにより、部門間の重複作業といった非効率が排除され、組織全体で一貫した方針のもと、安全かつ迅速にAI開発を進めることができる 7。明確なガバナンスは、開発者が安心してイノベーションに挑戦できる「ガードレール」の役割を果たし、結果として開発効率と運用性の向上に繋がる 7。

次に、企業イメージとブランド価値の向上に大きく貢献する。「責任あるAI(Responsible AI)」への真摯な取り組みは、企業の社会的評価(レピュテーション)を飛躍的に向上させる 11。顧客、投資家、ビジネスパートナーは、AIのリスクを適切に管理し、倫理的な配慮を怠らない誠実な企業を高く評価する 7。ガバナンスを通じて安全なAI活用を社会に示すことは、強固なブランドイメージの構築と顧客からの信頼獲得に繋がり、それが収益増加という形で結実する 7。

さらに、優秀な人材の獲得と定着にも有利に働く。AI分野のトップタレントは、単に技術的な挑戦だけでなく、自らの仕事が社会に与える影響や倫理性を重視する傾向が強い。倫理的な配慮を欠いたプロジェクトへの参加を嫌い、明確なAI倫理ポリシーとガバナンス体制を持つ企業を魅力的に感じるとされる。したがって、強固なAIガバナンス体制を整備することは、AI人材の確保・育成において重要な差別化要因となる 7。

このように、AIガバナンスはリスク管理という守りの側面から、イノベーションの促進、ブランド価値の向上、人材獲得といった攻めの側面まで、企業活動全体に広範な波及効果をもたらす。それはもはやコストではなく、持続的な成長を実現するための戦略的投資なのである。

第2章:信頼を構築するAIガバナンスの中核原則

AIガバナンスの成功は、その基盤となる一連の原則を組織全体で理解し、実践することにかかっている。これらの原則は、AIシステムに対する社会的な信頼を醸成し、企業が責任ある形でAIの便益を享受するための道標となる。本章では、信頼構築の根幹をなす「信頼の三要素」を深掘りし、より広範な「人間中心のAI社会原則」へと視野を広げ、最終的にこれらの抽象的な原則を具体的な企業ポリシーへと落とし込むプロセスを詳説する。

2.1 信頼の三要素:説明責任、透明性、説明可能性

AIに対する信頼を構築するためには、特に重要とされる3つの要素がある。これらは相互に関連し合い、強固なAIガバナンスの核心を形成する 1。

- 説明責任 (Accountability)

説明責任とは、「誰がAIガバナンスに責任を持つのか」を明確に定義することである 1。効果的なAIガバナンスは、役員層による明確なコミットメント、リーダーシップ、そして資金的な裏付けなしには実現しない。経営トップがAIガバナンスの重要性を理解し、全社的な取り組みとして推進する姿勢を示すことが不可欠である 1。具体的には、AIがもたらす影響に対する最終的な責任の所在を定め、重大な変化を管理するための高い基準を事前に設定し、これを遵守する体制を構築することが求められる 6。これにより、問題が発生した際に迅速かつ適切に対応できるだけでなく、組織全体に責任あるAI開発・利用の文化を根付かせることができる。 - 透明性 (Transparency)

透明性とは、AIアルゴリズムがどのように動作し、意思決定を行うかについて、明確性とオープンさを確保することである 6。特に、AIモデルの構築に使用されるデータソースの評価と、その情報を何をどこまで共有するかが重要となる 1。組織は、データがどのように処理され、共有されるかを包み隠さずオープンにすることが求められる 1。これにより、顧客や利用者は自身のデータがどのように利用されるかを理解し、納得した上でサービスを利用するかの意思決定が可能となる。また、AIが導き出した結果の背後にある論理と推論を説明できる能力は、ステークホルダーへの情報公開や対話の基盤となり、信頼醸成に不可欠である 6。 - 説明可能性 (Explainability)

説明可能性とは、AIシステムやモデルの出力を人間が理解できる形で説明する能力を指す 1。特に、判断プロセスが複雑で不透明になりがちなAIにおいて、なぜその結論に至ったのかを適切に説明できる状態を目指すことは極めて重要である 13。人間とAIシステムの真の連携は、この説明可能性によってもたらされる説得力に基づき、人間の感覚や判断をAIの意思決定プロセスに加えることで初めて成り立つ 1。説明と監査が可能なAIの出力を優先し、モデルの来歴(どのようなデータで、どのように学習されたか)を共有することは、信頼の基礎を築く上で欠かせない要素である 1。

2.2 人間中心のAI社会原則

信頼の三要素をさらに補強し、より広い社会的文脈でAIガバナンスを捉えるために、多くの国や国際機関が「人間中心」という理念を掲げている。日本政府が推進する「人間中心のAI社会原則」もその一つであり、企業がAIガバナンスを構築する上で指針とすべき重要な原則群を提示している 8。

- 人間尊重・公平性 (Human Dignity & Fairness)

AIは、人間の尊厳や自由、多様性を尊重するように設計・利用されなければならない 4。これは、AIの学習データやアルゴリズムに起因するバイアスや差別を回避し、不当な格差を生じさせないための取り組みを意味する 13。特に、個人の権利や利益に重要な影響を及ぼす可能性がある分野でAIを利用する場合、その出力の正確性を可能な限り維持しつつ、生じうる不利益を慎重に検討することが求められる 3。 - プライバシー保護 (Privacy Protection)

AIの学習や運用には大量のデータが不可欠であるが、その過程で個人のプライバシーが侵害されることがあってはならない 15。データプライバシーやセキュリティへの配慮は、AIガバナンスの基本であり、個人データの取り扱いに関する法令や社会規範を遵守し、適切なデータ管理体制を構築することが必須である 4。 - 安全性・セキュリティ確保 (Safety & Security)

AIシステムは、そのライフサイクル全体を通じて、頑健性(ロバストネス)、セキュリティ、そして安全性が確保されなければならない 16。これは、外部からの攻撃に対する防御策を講じることはもちろん、システムが意図しない動作によってステークホルダーの生命、身体、財産に危害を及ぼすことがないように設計・運用することを意味する 3。

これらの原則は、AIを単なる効率化のツールとしてではなく、人間社会を豊かにするためのパートナーとして位置づけるための基本的な考え方を示すものである。

2.3 原則から実践へ:企業理念とAI倫理ポリシーの整合性

これらの抽象的な原則を実効性のあるものにするためには、各企業が自社の理念やビジョンと整合させ、具体的な「AI倫理ポリシー」や「AIコミットメント」として文書化し、組織内外に公表することが重要である。先進的な企業は、こうしたポリシー策定を通じて、自社のAIに対する姿勢を明確に示している。

例えば、富士通は「富士通グループAIコミットメント」を策定し、「人を中心に考えたAI」や「企業の社会的責任としてのAIの透明性と説明責任」などを掲げている 17。日立製作所は「AI倫理原則」の中で、計画・社会実装・維持管理の3段階での行動規準を定め、実践的な項目を提示している 13。ソフトバンクは、「情報革命で人々を幸せに」という経営理念の下、「ソフトバンクAI倫理ポリシー」を策定し、自社の事業活動とAI倫理を結びつけている 13。

重要なのは、これらのポリシーが単なる美辞麗句で終わらないようにすることである。企業の根幹にある経営理念やパーパスと深く結びつけることで、AI倫理が全社的な文化として根付き、従業員一人ひとりの行動指針となる。役員層は、自社が策定した原則と日々の実践が乖離しないよう、一貫性を確保する責任を負う 1。このようにして初めて、原則は魂を宿し、信頼されるAIガバナンスの実践へと繋がるのである。

表1:主要企業におけるAI倫理原則・ポリシー比較

| 企業名 | ポリシー/原則の名称 | 強調されている主要原則 | 特徴的な取り組み |

| 日立製作所 | AI倫理原則 | 安全性、公平性、透明性、プライバシー保護、人間中心 | 社会イノベーション事業におけるAI活用に特化し、計画・社会実装・維持管理の3段階で具体的な行動規準を定めている 13。 |

| 富士通 | 富士通グループAIコミットメント | 人間中心、持続可能な社会、人の意思決定の尊重、透明性と説明責任 | 欧州のAI倫理機関と連携し、外部評価や取締役会での共有を通じてガバナンスを強化。社会価値創出とSDGsへの貢献を明確に位置づけている 13。 |

| ソフトバンク | ソフトバンクAI倫理ポリシー | 人権尊重、人間中心、公平性、透明性・説明責任、安全性 | 「情報革命で人々を幸せに」という経営理念とAI倫理を直結させ、AIの発展を牽引するリーダーとしての姿勢を打ち出している 13。 |

| 東芝 | 東芝グループAIガバナンスステートメント | 人間尊重、安心安全の確保、コンプライアンス、公平性、透明性と説明責任 | 経営理念体系をAI利活用の観点から具体化し、7つの観点で整理。AIを深く理解し利活用できる人材の育成も原則に含めている 4。 |

第3章:日本におけるAIガバナンスのフレームワーク:政府ガイドラインの詳解

日本企業がAIガバナンスを構築する上で、その羅針盤となるのが政府、特に経済産業省と総務省が共同で策定した一連のガイドラインである。これらの文書は、法的な拘束力を持たない「ソフトロー」として位置づけられつつも、事実上の業界標準として機能し、企業の自主的な取り組みを促す重要な役割を担っている。本章では、その中核となる「AI事業者ガイドライン」の全体像を解き明かし、その背景にある多層的なガバナンス構造と、変化し続ける技術環境に対応するための「アジャイル・ガバナンス」という思想について詳説する。

3.1 「AI事業者ガイドライン」の全体像と策定背景

2024年4月に公表された「AI事業者ガイドライン(第1.0版)」は、日本のAIガバナンスにおける画期的な文書である 18。このガイドラインの最大の特徴は、それまで個別に存在していた「AI利活用ガイドライン」や「AI原則実践のためのガバナンス・ガイドライン」など、国内の主要な3つのガイドラインを統合・アップデートした点にある 20。これにより、事業者にとって参照すべき指針が一本化され、より分かりやすく、一貫性のある枠組みが提供されることとなった。

この策定の背景には、2つの大きな潮流がある。一つは、技術革新への対応である。特に生成AIの急速な普及は、従来のAIとは異なる新たなリスク(ハルシネーション、著作権問題など)をもたらし、既存のガイドラインの見直しを迫った 19。もう一つは、国際的な議論との協調である。G7広島サミットで合意された「広島AIプロセス」など、AIガバナンスに関する国際的なルール形成の動きが活発化する中、日本として統一的な指針を示し、国際社会での議論に貢献するとともに、国内企業のグローバルな事業展開を支援する狙いがある 20。

ガイドラインは、日本の目指す未来社会像である「Society 5.0」の実現に向け、イノベーションの促進とリスクの緩和を両立させることを基本理念としている 20。AIを開発・提供・利用するすべての事業者を対象とし、事業者が自主的にAIのリスクを認識し、ライフサイクル全体で必要な対策を実行できるよう後押しすることを目的としている 20。

3.2 ガバナンスの4階層:AI原則、横断的ルール、個別分野ルール、モニタリング

「AI事業者ガイドライン」が位置づけられる日本のAIガバナンスの全体構造は、より大きな視点で見ると、4つの階層からなるフレームワークとして理解することができる 14。

- 第1階層:AI原則 (AI Principles)

これはガバナンスの最上位に位置する、技術中立的で普遍的なゴールである 14。日本政府の「人間中心のAI社会原則」やOECDのAI原則などがこれにあたり、「人間中心」「公平性」「透明性」といった、AIが最終的に保護・達成すべき価値を示す 15。 - 第2階層:横断的で中間的なルール (Cross-cutting & Intermediate Rules)

AI原則という抽象的なゴールと、企業の具体的な実践とを繋ぐ「橋渡し」の役割を担うのがこの階層である 14。ここには、法的拘束力のないガイドライン(「AI事業者ガイドライン」そのものが代表例)、ISO/IECなどの国際標準、そして将来的には分野横断的な法的拘束力のある規則が含まれる可能性がある 14。 - 第3階層:個別分野等にフォーカスしたルール (Sector-specific Rules)

特定の利用態様や業種に特化した、より具体的なルール群である 14。例えば、金融分野における与信審査AI、医療分野における診断支援AI、あるいは顔認証技術の利用など、各分野特有のリスクや文脈に応じた規制やガイドラインがここに該当する 14。 - 第4階層:モニタリングとエンフォースメント (Monitoring & Enforcement)

上記のルールが遵守されているかを確認し、実効性を担保するための仕組みである 14。これには、企業による自主的な監査、第三者機関による認証、そして規制違反に対する行政処分や制裁などが含まれる 14。

この階層構造は、抽象的な理念から具体的な実践までをシームレスに繋ぎ、社会全体としてAIを適切に統制するための体系的なアプローチを示している。

3.3 アジャイル・ガバナンス:変化に対応し続ける「Living Document」としての運用

日本のAIガバナンス・フレームワークを理解する上で最も重要な概念が「アジャイル・ガバナンス」である 5。これは、技術や社会の変化が激しいAI分野において、一度定めたルールを固定化するのではなく、状況の変化に応じて柔軟かつ迅速に見直し、改訂していくという考え方である 22。

従来の法規制(ルールベース)は、細かな行為義務を定めるため、技術が進化するとすぐに陳腐化し、かえってイノベーションを阻害するリスクがあった 22。一方、AI原則(ゴールベース)だけでは、抽象的すぎて企業が具体的に何をすべきかが分からず、原則と実践の間に「ガバナンスギャップ」が生じてしまう 22。

アジャイル・ガバナンスは、このギャップを埋めるためのアプローチである。「AI事業者ガイドライン」は、この思想を体現するものであり、「Living Document(生きている文書)」として位置づけられている 20。これは、政府単独ではなく、企業、研究機関、市民社会といった多様なステークホルダー(マルチステークホルダー)との対話を通じて、継続的に内容が評価・更新されていくことを意味する 20。

このアプローチは、企業に対して大きな示唆を与える。それは、規制当局からの指示を待つ受動的なコンプライアンス遵守ではなく、自らが社会の一員としてルール形成のプロセスに積極的に関与し、自社のガバナンス体制を継続的に改善していくという、能動的な姿勢が求められるということである 18。柔軟性が高い分、企業自身の自主性と責任がより一層問われる、これが日本型AIガバナンスの核心と言えるだろう。

第4章:AIガバナンス構築の実践的ロードマップ

AIガバナンスの理念や原則を理解した上で、次に問われるのは、それを組織内にどのように実装し、実効性のある仕組みとして定着させるかである。AIガバナンスの構築は、一度きりのプロジェクトではなく、継続的な改善を前提とした循環的なプロセスである。本章では、多くの専門機関やガイドラインで共通して示されている5つのステップに基づき、企業がAIガバナンスを構築・運用するための実践的なロードマップを提示する 10。

4.1 ステップ1:環境・リスク分析

すべての土台となるのが、自社とAIを取り巻く環境を正確に把握する「環境・リスク分析」である 15。このステップは、経営層のリーダーシップの下で実施され、主に3つの側面から構成される 10。

- AIがもたらす便益とリスクの理解:

自社の事業においてAIを導入・活用することで、どのような便益(コスト削減、生産性向上、新サービス創出など)が期待できるかを具体的に洗い出す。同時に、それに伴う潜在的なリスク(バイアス、プライバシー侵害、セキュリティ脆弱性、誤情報など)を特定し、その影響度と発生可能性を評価する 10。 - 社会的受容性の理解:

開発・提供・利用しようとしているAIシステムが、社会や顧客、従業員といったステークホルダーからどのように受け止められるかを分析する 10。特に、倫理的に機微な技術(顔認証など)や、個人の権利に大きな影響を与える可能性のあるAI(採用、与信など)については、社会的な期待と懸念を深く理解することが不可欠である。 - 自社のAI習熟度の理解:

組織としてAIを適切に管理・運用する能力がどの程度あるかを客観的に評価する 10。これには、AIに関する技術的知見を持つ人材の数やスキルレベル、従業員全体のAIリテラシー、既存のデータ管理体制などが含まれる。

この分析を通じて、自社が目指すべき方向性と、現在地とのギャップを明確にすることが、後続のステップの質を決定づける。

4.2 ステップ2:ゴール設定

環境・リスク分析の結果に基づき、自社がAIガバナンスを通じて何を目指すのか、その「ゴール」を具体的に設定する 15。このゴールは、自社の経営理念やビジョン、企業文化と深く整合している必要がある 10。

ゴール設定の具体的なアウトプットは、多くの場合、「AIポリシー」や「AI倫理指針」といった文書の形で策定される 7。この文書には、「AIをどのように活用し、どのような社会的価値を目指すのか」「どのようなリスクを特に重視し、いかなる場合も許容しないのか」といった組織の基本的な考え方や方針を明記する。

このゴールは、組織内の羅針盤として機能するだけでなく、可能な範囲で社外のステークホルダーにも公開することが推奨される 24。透明性を高めることで、顧客やパートナーからの信頼を獲得しやすくなるからである。

4.3 ステップ3:システムデザイン

設定したゴールを達成するための具体的な仕組み、すなわち「AIマネジメントシステム」を設計・構築するフェーズである 10。これはAIガバナンスの中核をなす、最も広範な取り組みとなる。

- 組織体制の整備:

AIガバナンスを推進・監督するための組織体制を構築する。これには、AIに関する意思決定機関(AI倫理委員会など)、ガバナンスを構築・運用する専門部門(CoE: Center of Excellenceなど)、そしてその活動を監査する部門の役割と責任を明確にすることが含まれる 1。法務、知財、リスク管理、IT、情報セキュリティ、事業部門など、分野横断的なメンバーで構成されることが望ましい 1。 - 方針・ルールの策定:

AIポリシーをさらに具体化し、AIの開発・提供・利用に関する詳細な社内ルールや手続きを定める 10。例えば、生成AIの利用ガイドライン、AIシステムの開発・調達プロセス、セキュリティ管理、プライバシー保護、インシデント対応手順などがこれにあたる 7。 - プロセス・ツールの導入:

AIのライフサイクル全体を通じてリスクを管理するためのプロセスを業務フローに組み込む。具体的には、企画段階でのリスクアセスメント、開発段階でのモデル検証、運用段階でのモニタリングといったプロセスを定義し、それらを支援するツール(リスク管理台帳、チェックリストなど)を整備する 10。 - データガバナンスの構築:

AIの品質と公平性は、その学習データに大きく依存する。そのため、AIシステムで使用する学習データや入出力データを適切に管理するためのデータガバナンス体制を構築することが不可欠である 10。 - 人材育成計画の策定と実行:

AIガバナンスを実効性のあるものにするためには、全従業員のAIリテラシー向上が欠かせない。経営層、管理者、開発者、一般利用者など、それぞれの役割に応じた教育・研修プログラムを計画し、継続的に実施する 7。

4.4 ステップ4:運用

設計したAIマネジメントシステムを実際の業務プロセスに展開し、組織内に定着させていくフェーズである 15。運用段階で重要なのは、ルールが形骸化しないようにすることである 11。

- 継続的なモニタリング:

運用中のAIシステムが期待通りに機能しているか、性能の劣化(モデルドリフト)や予期せぬバイアスが発生していないかを継続的に監視する 7。入力データや出力結果のログを取得・分析し、問題が発見されれば速やかに改善に繋げるPDCAサイクルを回すことが重要である。 - 説明可能性の確保と記録:

AIマネジメントシステムがどのように運用されているか(例:リスク評価がいつ、どのように実施されたか)を記録し、経営層や監査部門、規制当局といったステークホルダーに対して説明できる状態を維持する 10。 - ステークホルダーへの情報開示:

自社のAIガバナンスに関する取り組み状況を、統合報告書やサステナビリティレポートなどを通じて、非財務情報として積極的に開示することを検討する 24。これにより、説明責任を果たし、社会からの信頼を高めることができる。

4.5 ステップ5:評価と継続的改善

AIガバナンスは、一度構築したら終わりではない。その仕組みが実質的に機能しているかを定期的に評価し、継続的に改善していくことが不可欠である 11。

- 内部・外部による評価:

AIマネジメントシステムの設計や運用から独立した部門(内部監査部門など)や、第三者機関によって、システムが設定したゴール達成に向けて適切に機能しているかを客観的に評価する 11。監査結果は経営層に報告され、改善アクションへと繋げられる 11。 - ステークホルダーからのフィードバック:

顧客、従業員、有識者、ビジネスパートナーなど、社内外のステークホルダーからAIガバナンスに対する意見やフィードバックを積極的に求め、それを評価・改善プロセスに反映させることを検討する 24。

この評価結果は、再びステップ1の「環境・リスクの再分析」へとフィードバックされる。新たな技術の登場、社会情勢の変化、自社の事業戦略の変更などを踏まえて環境認識を更新し、ゴールやシステムデザインを常に見直していく。この循環的なプロセスこそが、アジャイル・ガバナンスの実践であり、企業の持続的な成長を支える強固な基盤となるのである 11。

第5章:導入における課題と戦略的解決策

AIガバナンスの構築は、理論通りに一直線に進むものではない。その過程では、技術的、組織的、そして人的な側面にわたる様々な課題に直面する。これらの障壁を乗り越えるためには、課題の本質を正確に理解し、戦略的な解決策を講じることが不可欠である。本章では、AIガバナンス導入における主要な課題を特定し、それらに対する具体的な解決策を論じる。特に、近年急速に普及した生成AI特有のリスクについては、実際のインシデント事例を基に詳細な対策を提示する。

5.1 技術的課題:「ブラックボックス問題」への対処

AI、特に深層学習モデルが抱える根源的な課題の一つが、その判断プロセスの不透明性、いわゆる「ブラックボックス問題」である 11。AIがなぜ特定の結論を出したのか、その論理的な根拠を人間が完全に理解することが困難な場合があり、これは公平性の検証やエラーの原因究明を著しく妨げる。

この課題に対する戦略的解決策は、完全な透明性を追求するだけでなく、管理可能性と説明可能性を確保するという視点に立つことである。

- 人間参加型(Human-in-the-Loop)システムの設計:

AIに最終的な意思決定を完全に委ねるのではなく、重要な判断ポイントで人間が介在し、監視・承認・介入できるシステムを設計する 1。これにより、AIの判断が不適切であった場合に、人間がそれを修正する機会を確保できる。 - 説明可能なAI(XAI)技術の活用:

判断根拠を可視化・説明する技術(XAI: Explainable AI)の導入を検討する。全てのAIモデルで完全な説明が可能になるわけではないが、判断に寄与した特徴量をハイライトするなどの手法を用いることで、透明性を一定程度向上させることができる。 - ロギングと監査可能性の徹底:

たとえ内部ロジックが不透明であっても、AIへの入力データ、出力結果、そしてその運用状況を詳細に記録(ロギング)し、後から追跡・監査できる仕組みを構築する 7。これにより、問題が発生した際に、どのような状況でどのような判断が下されたかを検証することが可能になる。

5.2 組織的課題:経営層のコミットメントと部門横断連携

AIガバナンス導入における最大の障壁は、技術的な問題よりもむしろ組織的なものであることが多い。その中でも特に深刻なのが、経営層の理解不足とコミットメントの欠如、そして部門間の縦割り構造である 11。

- 経営層のコミットメント確保:

AIガバナンスが単なるIT部門や法務部門の課題ではなく、全社的な経営課題であることを経営層が認識することがすべての出発点となる 1。そのために、リスク管理部門や推進部門は、AIガバナンスの欠如がもたらす具体的な事業リスク(評判毀損、法的制裁など)と、逆に適切なガバナンスがもたらす事業価値(ブランド向上、イノベーション促進など)を明確に示し、経営トップによる明確なリーダーシップと投資を引き出す必要がある 11。 - 部門横断的な推進体制の構築:

AIガバナンスは、IT、法務、リスク管理、コンプライアンス、人事、そして各事業部門といった多様な専門知識を結集して初めて機能する。部門間のサイロを打破し、これらの専門家から成る分野横断的な専門委員会やタスクフォースを設置することが極めて有効である 1。この組織が、全社的な方針策定、リスク評価、各部門への助言といったハブ機能を担うことで、一貫性のあるガバナンスが実現できる 6。

5.3 人材・文化的課題:全社的なAIリテラシーの向上

どれほど精緻なルールやシステムを設計しても、それを使う従業員の理解と協力がなければ形骸化してしまう。組織全体のAIリテラシーの不足は、ガバナンスを阻害する根深い課題である。

この課題への解決策は、役割に応じた戦略的な教育・研修プログラムの継続的な実施である 7。

- 全社員向け基礎教育:

eラーニングなどを活用し、全社員を対象にAIの基本的な仕組み、倫理原則、自社の利用ガイドライン、そして情報セキュリティに関する基礎知識を周知徹底する 12。 - 職種別専門教育:

AIを直接開発・運用する技術職には、バイアス検出・除去技術やセキュリティ対策といった技術的な研修を、顧客にAIソリューションを提案する営業職には、AIの能力と限界、倫理的な側面を顧客に正しく説明するための研修を実施するなど、役割に応じた専門的な教育を行う 12。 - 経営層向け教育:

経営層に対しては、AIがもたらす戦略的な機会とリスク、国内外の規制動向、ガバナンスの重要性について、有識者を招いたセミナーなどを通じて理解を深めてもらう 12。

こうした継続的な人材育成を通じて、AIを「正しく恐れ、賢く使う」文化を組織全体に醸成することが、AIガバナンスの持続可能性を担保する。

5.4 生成AI特有のリスクと対策:インシデント事例からの教訓

生成AIの登場は、これまでのAIガバナンスの議論に新たな次元のリスクをもたらした。これらのリスクは理論上の懸念ではなく、既に多くのインシデントとして現実化している 9。具体的な事例から教訓を学び、実践的な対策を講じることが急務である。

表2:生成AI利用における主要リスクと対策マトリクス

| 主要リスク | リスクの概要 | 実際のインシデント事例 | 組織的・方針的対策 | 技術的対策 |

| 機密情報漏洩 | 従業員が業務上の機密情報(ソースコード、顧客情報、未公開の財務情報など)をプロンプトとして入力し、それがAIの学習データとして利用されたり、外部に流出したりするリスク。 | エンジニアが業務効率化のため、機密のソースコードを外部の生成AIサービスに入力してしまった 9。 | 利用ガイドラインの策定と徹底: 入力禁止情報(機密情報、個人情報、知的財産)を具体的に定義し、全従業員に周知。定期的な研修を実施する 9。 | セキュアな環境の提供: 社内データのみで動作するプライベート環境や、入力データが学習に使われない契約の法人向けサービスを利用する。データマスキングやフィルタリング技術を導入する 13。 |

| ハルシネーション(誤情報生成) | AIが事実とは異なる情報を、もっともらしい形で生成するリスク。これを信じて利用することで、業務上の誤判断、信用の失墜、法的な問題に繋がる。 | 弁護士が生成AIが出力した架空の判例を確認せずに裁判所に提出し、制裁を受けた。また、AIチャットボットが誤った返金保証情報を提示し、企業が損害賠償を命じられた 9。 | 人間によるファクトチェックの義務化: AIの出力結果を鵜呑みにせず、特に重要な業務で利用する場合は、必ず一次情報や信頼できる情報源で裏付けを取るプロセスを業務フローに組み込む 9。 | RAG (Retrieval-Augmented Generation) の活用: 信頼できる社内文書やデータベースを参照して回答を生成する仕組みを導入し、根拠のない情報の生成を抑制する。回答に出典を明記させる 9。 |

| 知的財産権侵害 | AIが学習データに含まれる著作物などを基に、既存のコンテンツと酷似した画像、文章、コードなどを生成し、意図せず他者の著作権や特許を侵害してしまうリスク。 | ある企業が生成AIでアプリを開発したところ、既存の天気アプリと酷似したデザインが生成され、サービス停止に至った 9。 | 利用前のチェックプロセスの導入: 生成されたコンテンツを公開・商用利用する前に、既存の著作物との類似性チェックや、利用規約上での商用利用の可否を確認する手順を義務付ける 9。 | 著作権侵害リスクの低いモデルの選定: 学習データの透明性が高く、著作権に関してクリーンであることが明示されているAIモデルを選択する。生成コンテンツに電子透かし(ウォーターマーク)を付与する技術を活用する。 |

| 意図しない出力・悪用 | 悪意のあるプロンプト(プロンプトインジェクション)や巧妙な対話によって、AIが差別的、暴力的、あるいは企業の評判を損なうような不適切な応答をしてしまうリスク。 | 消費者がチャットボットを巧みに誘導し、「新車を1ドルで販売する」という異常な約束を取り付け、そのやり取りをSNSで公開し炎上した 9。 | 重要判断における人間介入の必須化: 価格交渉や契約締結など、事業に重大な影響を与える判断は、最終的に人間が承認するフローを設ける 9。インシデント発生時のエスカレーション体制を明確化する。 | プロンプトフィルタリングとガードレールの実装: 不適切な単語や攻撃的なプロンプトを検知・ブロックする仕組みを導入する。AIの応答内容を特定の範囲内に制限する「ガードレール」機能を設定する。 |

これらの対策は、単独で実施するのではなく、複層的に組み合わせることで初めて実効性を発揮する。技術的な対策と、組織的なルール作りや教育を両輪で進めることが、生成AI時代のリスクを乗り越え、その恩恵を安全に享受するための鍵となる。

第6章:先進企業に学ぶAIガバナンス実践事例

AIガバナンスの原則やフレームワークは、実際の組織においてどのように実践されているのか。本章では、国内外の先進企業による具体的な取り組みを分析し、その戦略や組織体制から実践的な知見を抽出する。業界の特性や企業文化によってアプローチは異なるが、共通しているのは、AIガバナンスを経営の中核に据え、信頼を基盤としたイノベーションを追求する姿勢である。

6.1 テクノロジー業界の先行事例:富士通・NEC

日本のテクノロジー業界を牽引する富士通とNECは、AIを社会に提供する企業としての責任を自覚し、早くから体系的なAIガバナンスの構築に取り組んできた。

- 富士通:コーポレートガバナンスと一体化したトップダウンアプローチ

富士通のAIガバナンスは、経営トップの強いコミットメントの下、コーポレートガバナンスの一環として深く組み込まれている点が特徴である 27。社長直下に設置された「AI倫理室」(旧AI倫理ガバナンス室)が司令塔となり、グループ全体の戦略策定や実践を主導している 27。

特筆すべきは、**外部有識者で構成される「AI倫理外部委員会」**の存在である 17。AI、法学、ジャーナリズムなど多様な分野の専門家が集うこの委員会には社長や副社長も出席し、客観的な視点から評価や助言を受ける。その審議内容は取締役会に報告され、経営監督に活かされるという徹底した体制が敷かれている 27。

実務レベルでは、**すべてのAI関連ビジネス案件に対して倫理リスク審査を義務付ける「全件審査」**を導入 17。リスクが高いと判断された案件は、技術、事業、人権、法律など多角的な観点から専門部門が検討し、深刻なリスクが除去できなければ「推進不可」として差し戻されるなど、厳格なプロセスが運用されている 17。 - NEC:人権尊重を核とした専門組織主導のアプローチ

NECは、特に生体認証技術など、人権への影響が大きいAI技術を扱ってきた経験から、「人権の尊重」をAIガバナンスの中核に据えている 30。その推進役を担うのが、2018年に設立された専門組織**「デジタルトラスト推進部」である 30。この部門は、法規制が未整備な「グレーゾーン」や変化する「社会受容性」にも配慮し、全社的な戦略策定や制度整備、研修などを主導している 30。

富士通と同様に、NECも法学者やNPO関係者などからなる外部有識者会議「デジタルトラスト諮問会議」**を設置し、多様な意見を取り入れながら新たな課題への対応を強化している 30。

リスク管理プロセスは、AIのライフサイクル(企画・提案、設計・開発、運用・保守)全体を網羅しており、各フェーズでリスクチェックを実施する仕組みが構築されている 12。また、全社員を対象としたAI倫理やリテラシーに関する研修にも力を入れており、人権に配慮した事業判断ができる人材の育成を目指している 12。

6.2 金融業界における厳格なガバナンス

金融業界は、顧客の機密情報を大量に扱い、厳格な規制下にあるため、AIの導入においても極めて高いレベルのガバナンスが求められる 31。

- 三菱UFJフィナンシャル・グループ(MUFG)

MUFGは、グループ全体でAIの活用とガバナンスを両立させるため、「MUFG AIポリシー」を策定している 31。この指針の下、グループ各社でAIの企画・開発・運用が適切に行われるための態勢・プロセスを構築。特に、AIによる与信スコアリングなどのブラックボックス問題に対しては、顧客への説明責任を果たすことの重要性を認識し、高いレベルの管理体制を目指している 31。行内手続きの照会や稟議書作成支援など、まずは内部業務の効率化からAI活用を進め、リスクを管理しながら適用範囲を拡大している 32。 - Wells Fargo:人材育成を先行させる人中心のアプローチ

米大手銀行のWells Fargoは、技術導入よりもまず「人」の準備を優先するアプローチを採っている。スタンフォード大学と連携し、4,000人以上の従業員を対象としたAI倫理教育プログラムを実施 33。AIの透明性や安全性を高めるための運用体制を整備し、複数のAIモデルを比較してアルゴリズムのバイアスをチェック・修正するプロセスを導入している 33。顧客に直接影響を与えるシステムよりも、まずは行内業務を支援するツールから導入を進めることで、責任あるAI活用のための強固な基盤を築き、従業員と顧客双方の信頼を醸成することに注力している 35。 - Goldman Sachs:技術的統制を核とするプラットフォームアプローチ

Goldman Sachsは、技術的なコントロールをガバナンスの中心に据えるアプローチを採っている。同社は、**中央集権化されたセキュアな「GS AI Platform」**を開発 33。このプラットフォームは、OpenAIのGPT-4のような強力な外部LLMを利用する際の唯一のゲートウェイとして機能し、すべてのやり取りが厳格なセキュリティ管理下に置かれる「ファイアウォール」環境を提供する 37。これにより、顧客データなどの機密情報を保護し、規制遵守を徹底しながら、最先端のAI技術を安全に活用し、イノベーションを加速させることを可能にしている 37。

これらの事例は、同じ金融業界であっても、企業文化や戦略的優先順位によってガバナンスの最適解が異なることを示唆している。Wells Fargoが従業員の意識改革と文化醸成を重視するのに対し、Goldman Sachsはプラットフォームによる技術的統制を優先している。これは、AIガバナンスに「唯一の正解」はなく、各社が自社の状況に合わせて最適なモデルを設計する必要があることを物語っている。

6.3 多様な業界での応用事例とインサイト

AIガバナンスの原則は、特定の業界に限らず普遍的に適用可能である。

- 小売業界: 大丸松坂屋百貨店では、ベーカリー部門で需要予測AIを導入し、売上を大幅に向上させると同時に食品ロスを削減した 32。ここでのガバナンスの要点は、予測の精度を継続的にモニタリングし、予測が外れた場合の原因を分析してモデルを改善するプロセスや、予測結果を鵜呑みにせず、最終的な発注判断は現場の経験豊富なスタッフが行うといった人間系のチェック機能の維持にある。

- 公益事業: 東京ガスは、顧客との通話内容をAIがリアルタイムでテキスト化・分析し、オペレーターを支援するシステムを導入している 32。このケースでは、顧客の個人情報保護が最優先課題となる。通話データがどのように扱われ、保存され、分析されるかについての透明性を確保し、顧客のプライバシーを侵害しないための厳格なデータガバナンスが不可欠である。

これらの事例から明らかなように、AIガバナンスの核心は、バイアスのない高品質なデータの確保、プロセスの透明性と説明可能性、そして最終的な意思決定における人間の適切な関与という、業界を問わない共通の課題に行き着く。各企業は、これらの普遍的な課題に対し、自社の事業内容やリスク特性に応じた具体的な管理策を講じていく必要がある。

結論:持続的成長とイノベーションを両立するAIガバナンスの未来

本レポートでは、AIガバナンスの定義、戦略的重要性、中核となる原則、そして具体的な構築ロードマップと先進企業の事例を包括的に分析してきた。ここから導き出される結論は、AIガバナンスがもはや単なる技術部門の課題やコンプライアンス上の要請ではなく、企業の持続的成長とイノベーションを両立させるための、経営戦略そのものであるということである。

AIガバナンスは、リスクをコントロールするだけでなく、現場でのイノベーションや業務改革を後押しする存在でなければならない 8。それは、一度構築すれば完了する静的なものではなく、技術の進化、社会規範の変化、そして自社の事業戦略に応じて絶えず見直され、改善され続ける**動的なプロセス、すなわち「旅」**である 11。日本政府が提唱する「アジャイル・ガバナンス」や「Living Document」という思想は、まさにこの本質を捉えている 20。

今後の展望として、AIガバナンスは企業の評価においてますます重要な位置を占めるようになるだろう。現在、投資家が企業のESG(環境・社会・ガバナンス)への取り組みを評価するように、将来的には、その企業の「AIガバナンス」の成熟度が、企業の将来性やリスク管理能力を測る重要な指標となる可能性が高い。AIガバナンスに関する取り組みを非財務情報として積極的に開示することは、ステークホルダーからの信頼を獲得し、企業価値を高める上で不可欠な要素となる 24。

AIの導入と活用は、もはや選択肢ではなく、あらゆる企業にとっての必須命題である。しかし、その導入が成功するか否かは、技術の優劣だけでなく、それを支えるガバナンスの質にかかっている。強固なAIガバナンスを構築することは、倫理的・社会的な責任を果たすと同時に、組織全体に一貫した方針を与え、開発の属人化や非効率を防ぎ、イノベーションのスピードを高める 11。それは、AIという強力なエンジンを安全かつ最大限に活用するための、いわば「OS(オペレーティングシステム)」の役割を果たす。

AI時代における真の勝者とは、最も強力なAIを開発した企業ではなく、最も信頼されるAIを社会に提供し、その恩恵を人間中心の価値観の下で持続的に享受する仕組みを構築した企業である。そのための羅針盤こそが、本レポートで詳説してきたAIガバナンスに他ならない。経営者は、この戦略的重要性を深く認識し、全社を挙げてその構築と実践に取り組むことが、未来への確かな一歩となるであろう。

引用文献

- 企業のための AIガバナンス・ガイド | IBM https://www.ibm.com/thought-leadership/institute-business-value/jp-ja/report/ai-governance

- AI 事業者ガイドライン – 総務省 https://www.soumu.go.jp/main_content/001002576.pdf

- AI 事業者ガイドライン https://www.kantei.go.jp/jp/singi/titeki2/ai_kentoukai/gijisidai/dai7/sankou2.pdf

- 信頼できるAIを支える東芝のAIガバナンス https://www.global.toshiba/jp/technology/corporate/ai/governance.html

- AIガバナンスとは? | コラム – 東京海上ディーアール株式会社 https://www.tokio-dr.jp/publication/column/210.html

- AIガバナンスとは – IBM https://www.ibm.com/jp-ja/think/topics/ai-governance

- AIガバナンス | PwC Japanグループ https://www.pwc.com/jp/ja/services/consulting/analytics/responsible-ai.html

- AIガバナンスとは|企業が知るべき基本概念と運用のポイント – AeyeScan https://www.aeyescan.jp/blog/ai-governance/

- ここから始める生成AIガバナンス ~インシデント事例から学ぶ … https://www.sompo-rc.co.jp/columns/view/126

- AIガバナンス構築・運用支援 – AI Risk Transformation – KPMGジャパン https://kpmg.com/jp/ja/home/services/advisory/risk-consulting/digital-risk-management/ai-governance-support.html

- AIガバナンス―企業に求められるあるべき姿と導入メリットについて … https://monstar-lab.com/dx/technology/ai-governance/

- AIガバナンスに関する取組事例 https://www.soumu.go.jp/main_content/000770820.pdf

- 【2025/03】AIガバナンスを強化するための主要ガイドラインと実践 … https://j-aic.com/techblog/ai-governance-guidelines-and-practices

- AIガバナンスの考え方 – KPMGジャパン – KPMG International https://kpmg.com/jp/ja/home/insights/2023/08/ai-regulation-explanation-02.html

- AIガバナンスとは?4つの要素やガイドライン策定の流れを解説 … https://n-v-l.co/blog/ai-governance

- 世界の動向を踏まえた、AIガバナンスの実践~AI原則の一歩先へ~[前編] https://businessandlaw.jp/articles/a20220203-1/

- 富士通のAI倫理ガバナンス – Fujitsu https://global.fujitsu/ja-jp/technology/key-technologies/ai/aiethics/governance

- AI事業者ガイドラインの公表 2024年05月10日 | 大和総研 | 矢田 歌菜絵 https://www.dir.co.jp/report/research/law-research/law-others/20240510_024389.html

- 「AI事業者ガイドライン(第1.0版)」を取りまとめました (METI/経済産業省) https://www.meti.go.jp/press/2024/04/20240419004/20240419004.html

- AI事業者ガイドライン (第1.1版) 概要 – 経済産業省 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20250328_2.pdf

- 総務省と経済産業省が策定した「AI事業者ガイドライン」とは? – PC-Webzine https://www.pc-webzine.com/article/3133

- AIガバナンスに関するコラム:「AI原則実践のためのガバナンス … https://www.pwc.com/jp/ja/knowledge/column/ai-governance/ai-governance-guideline.html

- あなたの会社は大丈夫? AIガバナンス構築、失敗しないための5つの … https://chatgpt-enterprise.jp/blog/ai-governance/

- 戦略的AIガバナンス――イノベーティブなAIサービスを社会実装しスケールさせていくための戦略課題 | PwC Japanグループ https://www.pwc.com/jp/ja/knowledge/prmagazine/pwcs-view/202109/34-02.html

- AI(人工知能)-ガバナンス | NTTデータ – NTT DATA https://www.nttdata.com/jp/ja/services/data-and-intelligence/governance/

- AI原則実践のためのガバナンス・ガイドライン – 経済産業省 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20220128_1.pdf

- 富士通のAIガバナンスに関する取り組み https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/2021_005_02_00.pdf

- 富士通のAI倫理ガバナンス – 経済産業省 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/2022_008_02_00.pdf

- AI倫理室(富士通) – 採用情報 https://fujitsu.recruiting.jp.fujitsu.com/about/department/post-18377/

- NECのAIガバナンスの取り組み – 経済産業省 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/2022_006_04_00.pdf

- 【AI Governance Leaders】 金融業界のAI革命最前線 AIガバナンス協会理事 山本 忠司インタビュー https://www.ai-governance.jp/blog-articles/media-250828

- AI導入事例7選| 医療や小売など業界別にわかる活用方法とメリット – 株式会社EQUES https://eques.co.jp/column/ai-case-studies/

- 生成AIの台頭で大きく注目されるAIガバナンス https://www.jri.co.jp/file/advanced/advanced-technology/pdf/15711.pdf

- AI and Automation in Banking: Transforming Workplace Services – WWT https://www.wwt.com/wwt-research/ai-and-automation-in-banking-transforming-workplace-services

- Wells Fargo brings the agentic era to financial services with Google Cloud AI https://cloud.google.com/blog/topics/financial-services/wells-fargo-agentic-ai-agentspace-empowering-workers

- Case Study: AI-Driven Transformation at Wells Fargo – AIX – AI Expert Network https://aiexpert.network/ai-at-wells-fargo/

- AI Adoption: Goldman Sachs vs JPMorgan Benchmark https://sparkco.ai/blog/ai-adoption-goldman-sachs-vs-jpmorgan-benchmark

- AI Governance Guide: Implementing Ethical AI Systems – Kong Inc. https://konghq.com/blog/learning-center/what-is-ai-governance