大規模言語モデルの限界と停滞

近年は「より大きなモデルほど性能が向上する」という流れでLLM(大規模言語モデル)の開発競争が進んできました。しかし、規模拡大による性能向上は次第に頭打ちになり、技術的・経済的な壁が顕在化しつつあります[1][2]。まず、開発コストとエネルギー消費の問題があります。最先端モデルの学習には電力とハードウェアに1,000万ドル以上かかるとも言われ、学習・推論で莫大なエネルギーを消費するため環境負荷や費用負担が無視できません[3]。例えばGPT-4では約1.75兆ものパラメータがあり、これだけの規模を訓練・運用するには専用GPU/TPUの大規模クラスターが必要で、電力消費も膨大です[4]。加えて、LLMは高性能GPUメモリを大量に占有するためローカル(オンプレミス)での利用が難しく、クラウド経由で使わざるを得ないことが多いです。このため機密データをクラウドに送るリスクやレイテンシ(遅延)問題が生じ、医療・金融などでは導入の障壁となります[5]。

またスケーラビリティの課題も深刻です。大規模モデルの推論コストはユーザ数の増加に対して非線形に増大し、数千~数百万ユーザにLLMサービスを提供しようとすると膨大な計算資源が必要となります[6]。需要に応じた動的スケーリングをしなければ遅延の増大や運用コストの急騰を招き、従来型の重厚なインフラでは対応しきれなくなります[7]。さらにハードウェア面の制約として、2024年には世界的なGPU供給不足で価格高騰(最大40%増)に見舞われ、多くの企業が必要なGPUを確保できずLLM導入計画が停滞するといった事態も起きました[8]。LLMは膨大なメモリを要するため、GPU不足下での導入は困難です。このメモリ問題に対し、一部では量子化(モデルの計算精度を下げる圧縮)が用いられており、精度をほぼ落とさずメモリ使用量を30~50%削減できるとの報告があります[9]。しかし根本的には、LLMは巨大すぎて扱いにくい(「大きすぎるが故の不便さ」)というジレンマに直面しています。応答時間も長く(場合によっては数秒~数分[10])、リアルタイム性が要求される用途には不向きです。また万能型ゆえに専門領域のタスクでは性能が十分でない場合も多く、その都度高コストな追加学習が必要になるなど運用上のハードルもあります[11]。総じて、LLMの「巨大さ」は開発費・エネルギー・インフラ・応答速度・特化適応など様々な側面で限界と非効率を露呈し始めており、業界内でも「もはやモデルを大きくしてもリターンが少ないのでは」との見方が強まっています[1][2]。

小規模言語モデル(SLM)の技術的優位性と進化

こうした中で注目されているのが、より小規模で軽量な言語モデル(SLM)です。SLMは明確な定義があるわけではありませんが、「特定タスクで発現する能力をギリギリ示せる最小サイズから、資源制約下で扱える最大サイズまで」をカバーするモデルと提案されています[12]。大まかには数百万~数十億パラメータ級のモデルを指し、スマホ等で動かす観点からおおむね10億パラメータ以下(または最大でも10~13億程度)との見方もあります[13]。例えばMeta社のLlama2 7B(70億)やLlama1 13B(130億)クラスでもSLMと見做す場合がありますし、明確な線引きは難しいですが、LLMと比べ明らかに「小さいモデル」全般を指す概念です。

SLMの利点は何と言っても効率性と低コストにあります。パラメータが少ない分、学習・推論に要する計算資源が大幅に削減されます[14]。その結果、メモリやストレージの必要容量も減り、低電力デバイスでも扱えるため、レイテンシも小さくリアルタイム応答に向くなど実用上のメリットが多々あります[14][15]。実際、Hugging Faceコミュニティでのモデルダウンロード動向を見ると、小型モデルの人気が大型モデルを上回る傾向があり[14]、コミュニティ全体が「大きさより使いやすさ」に価値を見出し始めていることが示唆されています(実際、2024年10月時点の統計では各種モデルで小型版の方が大幅に多くダウンロードされていました[14])。SLMは低い計算資源でも動作するため省エネであり[15]、これは環境負荷低減にも繋がります。またオンデバイスAIを可能にすることでプライバシー強化にも寄与します[15](クラウドにデータを送らずに済む)。さらに軽量なおかげでカスタマイズ(ファインチューニング)もしやすく、特定分野に特化したモデルを作りやすいという柔軟性も重要です[15]。総じてSLMは性能と効率のバランスに優れ、実用ニーズに即した「ちょうど良い大きさのAI」として脚光を浴びています。「大きいほど賢い」という時代から「小さくても賢い」時代への転換が始まっているとも言われています[16]。

技術的な進化の面でも、近年はSLMを高性能化するための様々な工夫が研究されています。代表的なものとして以下のような手法が挙げられます[17][18]:

- 知識蒸留(Knowledge Distillation):大規模な教師モデル(LLM)の知識を小規模な生徒モデル(SLM)に移す学習法です[19]。これによりゼロから訓練するより効率よく高性能なSLMを得ることができます。最近では蒸留の改良も進んでおり、例えばSakana AIはLLMからSLMへ段階的に知識を移す「TAID」と呼ぶ新手法を開発し、32億パラメータLLMの知識を1.5億パラメータの日本語SLMに転移させ同規模モデル中で最高性能を達成したと報告しています[20][21]。このように工夫次第で小型モデルでも大モデルに匹敵する知識を持たせることが可能になりつつあります。

- モデル圧縮(プルーニングと量子化):モデル内部の不要な重みを削減するプルーニング(剪定)や、計算の数値精度を下げてモデルサイズを縮小する量子化が広く用いられています[19]。量子化では例えば32-bit精度を16-bitや8-bitに落とすことでモデルのメモリフットプリントを劇的に縮小でき、精度低下を最小限に抑えつつメモリ使用量を30~50%削減できた例もあります[9]。これによりスマートフォン等の限られたメモリ上でも高度なモデルを動作させることが可能です。

- Mixture-of-Experts(MoE):巨大モデルを複数の専門家ネットワークに分割し、入力に応じて一部のエキスパートのみを動作させるアーキテクチャです。MoEによりモデル全体のパラメータは増やしつつも各推論で使う部分は小さく抑えることが可能になり、計算効率を維持しながらモデル容量を事実上拡張できます[18][22]。SLMでもMoE的な手法を導入して性能向上と計算負荷削減の両立を図る研究が進んでいます。

- LoRA(Low-Rank Adaptation):大規模モデルの微調整を効率化する手法で、モデル全体ではなく一部の小さな低ランク行列だけを学習させることで微調整時の計算コストを劇的に下げます[23][24]。例えば1750億パラメータのGPT-3の全重みを更新するのは莫大な計算資源を要しますが、LoRAならごく一部のパラメータ(数百万程度)を追加学習するだけで済みます[25][23]。これによりメモリ使用量・計算量を大幅削減でき、限られたGPU環境でも大モデルのタスク適応が可能となります[24]。LoRAはモデルの過学習を抑える効果もありつつ、高速にドメイン適応モデルを量産できるので、小規模モデルの素早いカスタマイズにも適しています[26]。

この他にも、大規模モデルで実績のある人間フィードバックによる微調整(RLHF)や外部知識を取り込むRAG(Retrieval-Augmented Generation)の応用、パラメータ共有型の効率的アーキテクチャ(ALBERTのような層間重み共有など)[18]、より効率的な活性化関数や正則化の工夫[27]など、小規模モデルならではの性能向上手法が数多く提案されています。要するに、「小さくても賢い」モデルを作るための技術的土台は着実に整備されつつあるのです。

小規模モデルの主なユースケースと適用領域

SLMの特性から、自ずとその適用領域やユースケースもLLMとは異なる傾向が見られます。汎用万能なLLMに対し、SLMは必要十分な機能にフォーカスした特化型として使われるケースが増えています[28]。具体的には以下のような分野・用途でSLMの活躍が期待されています。

- 専門特化型AIアシスタント:医療、法務、金融、製造など特定業界・業務に特化した対話エージェントや質問応答システムにSLMが適しています[29]。LLMのように百科事典的知識は持たせずとも、該当領域の専門知識に絞って学習させれば、小さなモデルでも必要十分な精度で応答可能です[30][29]。例えば契約書レビュー専用の法務モデルを自社データで訓練するなら、汎用LLMよりSLMの方が効率的で精度も高まるでしょう[29]。

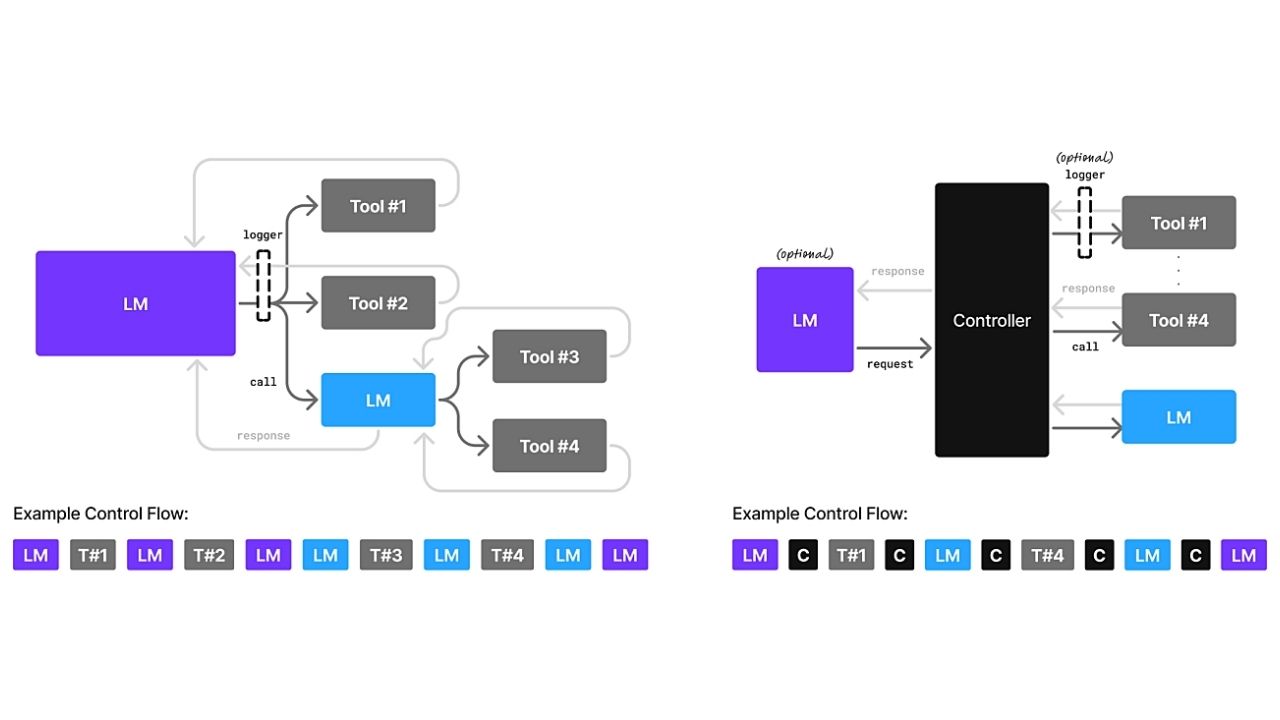

- マイクロサービス化・マルチエージェント:一つの巨大モデルに何でも任せるのではなく、タスク毎に小さなモデルを組み合わせて協調動作させるアーキテクチャも注目されています[31]。例えば社内の問い合わせ対応AIを、FAQ回答にはモデルA、在庫確認にはモデルB、感情分析にはモデルCといったように役割別のSLMエージェント群で構成するイメージです。各SLMが「デジタル工場の作業員」、LLMは必要時だけ呼ばれる「コンサルタント」という比喩もあります[32]。このような複数SLMのオーケストレーションは、大規模単体モデルより信頼性や拡張性で勝る可能性が指摘されています[31][33]。実際、NVIDIAの提唱する「エージェント的AI」では、基本はSLMが多数働き、どうしても必要な場合のみLLMを使う異種混在型が有望とされています[34][35]。これはモノリシックな巨大LLMからマイクロサービス的な複数SLMへの移行とも言え、クラウドソフトウェアが巨大サーバからマイクロサービスに移った過去の流れに似ているとも評されています[36]。

- 組込みシステム・IoT/エッジデバイス:SLM最大の強みはデバイス上で直接動作可能なことです。パラメータ数が小さいおかげでスマートフォンや組込みボード上でも推論が実行でき、インターネットに接続せず動かせるためユビキタス環境でのAI活用が一気に広がります[37][38]。実際、スマホ上でリアルタイム対話するチャットボットや、工場設備内に組み込んで動作する異常検知AI、家庭用家電に搭載される対話インターフェースなどにSLMが活用され始めています。ある程度性能を妥協すれば、数億パラメータ級のモデルならRaspberry Piでも動くとの報告もあります[39](実際、1億パラメータ台のLlama系モデルが古いPCや小型ボードでも載せられることが示されています[39])。このようにエッジAI領域では「小ささ」が決定的な武器となり、SLMはまさにEdge Computing時代のAIの主役になり得る存在です[40]。

- リアルタイム制御・自律エージェント:ドローンやロボット、車載システムなどリアルタイム応答が求められる自律エージェントでもSLMが有望です。LLMでは応答遅延が大きすぎる場面でも、SLMなら軽快にミリ秒~秒単位で動作し得ます。またこれらエージェントでは限られた計算資源上で複数AIモジュールを動かす必要があり、各モジュールが小さいことが全体システムの実現性を左右します。したがって、自律走行車のナビゲーションAI、産業ロボットの制御AI、スマート家電の音声対話AIなど、組込みリアルタイムAIの各所に小規模モデルが組み込まれていくでしょう。

以上のように、SLMは特化性能と軽量動作を武器に様々なユースケースでLLMにはない活躍を見せつつあります。特にエッジ側でのAI利用や企業内のニッチ課題解決では、もはや「大きいモデルを持ってくる必要はなく、適切に調教された小さなモデルの方がかえって精度も効率も高い」という状況が現れています[41]。実際、多くの企業が「広い知識より自社用途にフィットする精度・効率を」重視し始めており、SLMは精度・速度・プライバシー・コストの面でニーズにかなう「目的適合型」ソリューションとして評価されています[41]。

日本企業にとってのビジネスチャンス

SLMの台頭は、日本企業にとっても大きなビジネスチャンスとなりえます。従来、生成AIと言えばOpenAIやGoogleなど海外の巨大LLMを利用するケースが主流でした。しかし前述の通り、LLMは導入コストが高く(クラウド利用料やGPU費用)、機密情報を外部クラウドに預けるリスクもあります[42]。その点、SLMであれば自社内で比較的安価にモデルを構築・運用でき、データも社内にとどめたまま処理できるため、コスト・セキュリティ両面でメリットが大きいです[42]。実際、SLMならサーバ負荷やクラウド費用を抑えられるため運用コストの大幅削減が可能であり、さらにローカル推論によるデータ保護で情報漏洩リスクの軽減にも繋がると評価されています[42]。これは機密情報を扱う日本企業にとって非常に魅力的なポイントです。

またSLMは小回りが利くため、自社業務や国内市場に特化したAIサービスを独自開発しやすい利点もあります[43][44]。大規模モデルを一から作るには莫大なテキストデータと計算資源が必要で、現実的にGAFAレベルの企業でないと難しいですが、SLMであれば比較的少量のデータでも有用なモデルが作れる場合があります[45]。例えば日本語の業界特化データを使ってSLMを訓練すれば、大量の汎用英語データで訓練されたLLMよりも当該業界のニーズにマッチしたモデルを短期間で作れる可能性があります[46]。これは日本語リソースが限られる環境でも高性能モデルを生み出せることを意味し、日本企業・大学にとっては国内ニーズに即したAIを自前で育成できるチャンスです。

実際、日本でもSLM開発への取り組みが徐々に増加してきています[47]。例えば、NTTは2024年3月にパラメータ70億と6億の2種類の日本語モデル「綴(つづみ)」を公開しており[48]、これは事実上日本版GPT-3と言える自社LLM/SLM開発の先駆けとなりました。またNECも2024年4月末に130億パラメータの日本語モデル群「cotomi」シリーズをリリースしています[48](130億は厳密にはLLM寄りですが、GPT-4等と比べれば小さい部類であり、日本語特化モデルとして位置づけられています)。他にも、スタートアップや大学発のプロジェクトが続々登場しています。先述のSakana AIは東京科学大学との共同研究で高性能な日本語1.5億モデル「TinySwallow-1.5B」を開発・公開しました[49]。このモデルは独自の蒸留手法で同規模帯トップクラスの日本語能力を達成し、スマートフォン上で完全オフライン動作も可能とされています[21][50]。また東大発の研究チームが多言語1.42億パラメータの視覚言語モデルを公開した例[51]や、産総研らによる小型日英双方向モデルの開発など、産学でのSLM開発が進んでいます。「自社専用LLMを持ちたい」という企業ニーズは高いもののLLMはハードルが高いのが実情でしたが[52]、SLMならば「自社専用AI」を実現できる現実的な路線となりつつあります。これにより、例えば業界特化AIエージェントの創出や社内ナレッジを活用したチャットボット、組み込みAI搭載製品の開発など、日本企業が主体的にAIビジネスを創出できる余地が広がっています。

要するに、SLMは日本においてコスト面で手の届くAI開発を可能にし、しかも日本語・国内需要に特化した差別化AIを作れる武器となります。巨大LLMの時代には海外に大きく水をあけられていた感もありますが、SLMを上手く活用すれば日本企業もスピーディーかつ安全にAIソリューションを展開できるでしょう。実際、「LLM一辺倒ではなくSLMを含む混在構成で用途に応じ使い分けるべき」との提言も国内でなされています[53]。SLMの波は、日本のAI戦略に新たな道を拓くチャンスなのです。

国内外の主要なSLMプロジェクト事例

ここでは、世界および国内の代表的な小規模言語モデルプロジェクトをいくつか紹介します。SLMと一口に言っても様々なモデルがあり、各プロジェクトが工夫を凝らして小さくとも強力なモデルを生み出しています。それらの規模や特徴、性能を比較するため、以下に主要モデルの概要を表形式でまとめます。

| モデル (開発主体) | 規模 | 特徴・性能 |

| Phi-2 (Microsoft) | 27億パラメータ | 教師データを厳選した高品質学習で25倍大きなモデルに匹敵する性能を達成[54](常識推論・数学・コーディングでLlama2-70Bを凌駕)。「Textbooks Are All You Need」戦略で教科書レベルの知識を凝縮し、短期学習(14日間・96GPU)で高性能化[55][56]。未調整のベースモデルながら低毒性で安全性も高い[57]。 |

| Mistral 7B (Mistral AI) | 73億パラメータ | 2023年公開。高効率なGrouped-Query Attention (GQA)とスライドウィンドウ注意で長文にも対応[58]。Llama2-13Bを全ベンチマークで上回り、Llama1-34Bに匹敵する性能[59]を示し、特にコード・推論分野で優秀[60]。Apache2.0ライセンスで公開され、誰でも商用利用可能なオープンモデルとして注目[61]。 |

| Gemma (Google DeepMind) | 2億~270億パラメータ | Geminiモデル技術を基にした軽量オープンモデル群[62]。初代Gemmaは2B/7Bで登場し、コード・数学データに特化[63]。第2世代Gemma2では2B/9B/27Bとラインナップ拡充し効率・性能向上[64]。無料でウェイト公開され商用利用可。ラップトップやスマホ上でも動作しうるよう最適化されている[62]。コード特化のCodeGemmaやマルチモーダルのPaliGemmaなど派生も展開。 |

| 綴・Tsuzumi (NTT) | 70億 / 6億パラメータ | 2024年3月公開の日本語モデル[48]。社内公開LLMとしてスタートしつつ、規模は抑えて日本語特化の高性能を狙う。オープン提供され、企業内検証などにも利用可能。現時点で詳細なベンチマークは不明だが、日本語のチャットや質問応答に強みを持つとされる。 |

| cotomi (NEC) | 130億パラメータ | 2024年4月公開の日本語モデル群[48]。NECが開発した企業向け生成AIシリーズで、日本語文章の生成・要約・対話に対応。パラメータはLLM級だが国内特化型SLM的位置づけ。モデル評価指標等は公開されていないものの、日本語文章での応答精度向上に注力。 |

| TinySwallow-1.5B (Sakana AI/東京科学大) | 15億パラメータ | 2025年1月発表の日本語SLM[65]。独自蒸留法TAIDで32Bモデルの知識を移植し、同規模トップクラスの日本語能力を達成[20][21]。スマホ上でのリアルタイム対話が可能で、Webデモやオフライン実行環境も提供[66][50]。ICLR採択の先端研究成果として注目。 |

※表中の「規模」はおおよそのパラメータ数。「特徴・性能」は公開情報に基づく概要。引用に示すように、小規模ながら大規模モデルに匹敵・凌駕する性能を達成した例もある。

上記のように、海外ではMicrosoftやGoogle、スタートアップ企業が競って高性能SLMを開発しており、PhiやMistral、Gemmaといった名前がその代表例です。一方国内でもNTTやNECが独自モデルを投入し、大学発ベンチャー等も先進的な研究を進めている状況です。特筆すべきは、Phi-2やMistral 7Bのように「小さくても大きなモデルを打ち負かす」事例が既に現実にあることです。Phi-2はたった27億パラメータでありながら7億~13億のモデルを上回り、さらに70億規模のモデルすら特定タスクで凌駕したという報告がなされています[54]。Mistral 7Bも同様に、13億や34億規模の既存モデルに匹敵する性能を示しました[59]。これらはデータ質の向上やアーキテクチャ工夫で「スケーリング則」を打ち破った成果と言え、SLMの潜在力を示しています。GoogleのGemmaシリーズもGemini(次世代LLM)の技術を生かしつつサイズを絞ったモデル群で、一般公開かつ商用利用可能という点で大きなインパクトがありました[62][67]。国内では規模こそ数十億規模が中心ですが、日本語特化やエッジデバイス実行などニッチ戦略で独自性を出しています。TinySwallow-1.5Bのようにスマホ上で使える日本語モデルが登場したことは、日本のAIコミュニティに新風を吹き込みました[21][50]。

このように主要プロジェクトを俯瞰すると、SLM分野はオープンソースの動きが活発であり、各社・各コミュニティが競い合って「小さくて強いモデル」を生み出しています。PhiやMistralの成功は「大規模モデル信仰」に一石を投じ、Gemmaや各種オープンモデルの登場は誰もが小さな強力モデルを手に入れられる時代の幕開けを告げています。日本勢も含め、これからも多様なSLMが生み出されていくでしょう。

小規模モデルを支えるオープンソースエコシステム

SLMの普及を後押ししているのが、充実したオープンソースエコシステムの存在です。特にHugging Faceはその中心的な役割を果たしています。Hugging Faceのモデルハブには世界中のSLMがアップロードされており、研究者や開発者は自由にモデルを入手できます。また変換・圧縮・微調整のための各種ツールも提供されており、例えばHugging Faceはllama.cpp向けにモデルをGGUF形式へ変換・量子化・ホスティングするオンラインツールまで整備しています[68]。これにより、人気のLlama系モデルなどを簡単に軽量化して手元のデバイスで動かすことができます。

実際、llama.cppはSLMエコシステムの立役者です。これはFacebook(現Meta)のLLM「Llama」を含む各種モデルをスタンドアロンでCPU上などで高速実行するために作られたC++実装で、現在ではGPT-2からLlama2、Mistral、Gemmaに至るまで様々なモデルをサポートしています[69]。llama.cppとその派生プロジェクトにより、従来GPUが必須だったモデル推論が一般PCやモバイル端末でも可能になりました。例えば先述のように1~3億パラメータ台のモデルであればRaspberry Piでも実用的に動作しうるとの報告があります[39]。これはエッジ用途で非常に重要で、llama.cppのおかげで「モデルをクラウドではなく手元で走らせる」選択肢が現実味を帯びました。現在ではAppleのMシリーズチップ上で数十億パラメータモデルを動かす試みや、Androidデバイス上でのオンデバイスLLM実行など、llama.cppを基盤としたコミュニティが急速に発展しています。

さらにLangChainのようなフレームワークもSLM普及を支えています。LangChainは様々な言語モデルを組み合わせて対話エージェントやツール使用AIを構築するためのライブラリで、SLMを含む多数のモデルを簡単に呼び出して高度なチェーン(連携処理)を定義できます。特に複数モデルを組み合わせるマルチエージェント的なシナリオでは、LangChainがあることでSLM同士、あるいはSLMとLLMをうまく役割分担させながら一つのシステムを構築できます。Hugging Faceのモデルとも統合が進んでおり、LangChainから直接Hugging Face上のモデルをロードして使うことも容易です[70]。こうしたフレームワークにより、企業は自社ニーズに合わせてSLMを組み込んだAIワークフローを構築しやすくなっています。

コミュニティベースの支援も見逃せません。Hugging FaceのTransformersライブラリは最新のSLMを次々とサポートしており、推論から微調整まで統一的インターフェースで扱えます。またPEFT (Parameter-Efficient Fine-Tuning)ライブラリではLoRAを始めとする微調整手法を簡単に適用でき、巨大モデルだけでなくSLMに対しても低リソースでの微調整が可能です。これらオープンソースツールの充実によって、研究者だけでなく企業内のエンジニアや個人開発者までもがSLMを自在に扱える環境が整いました。加えて、モデル評価指標の共有やベンチマーク協議会も活発化し、例えばElephasやOpenLLMLeaderboardといったサイトで小型モデルのランキングが公開されています。これにより「どのSLMが優れているか」を透明性高く議論でき、健全な競争と進歩が促されています。

最後に、オープンソースコミュニティの文化自体がSLM推進に寄与しています。LLM時代には巨大モデルを各社が社内開発し非公開とするケースが多かったですが、SLMではオープンにモデル重みを公開し合い、改良版を派生させ、知見を共有する動きが盛んです[67]。上述のGemmaやMistralもオープンモデルですし、Phiシリーズも研究目的で提供されています。日本国内でも、先の綴やcotomiは社内向けながら学会等で知見が共有されつつあり、TinySwallowは完全オープンです。オープンエコシステムを通じた知の集積こそが、小回りの利くSLMをさらに進化させ、LLMに代わる主流に押し上げる原動力と言えるでしょう。

以上、技術基盤・ユースケース・ビジネス機会・プロジェクト事例・エコソース環境と多面的に見てきました。総じて言えるのは、大規模モデル一辺倒だった生成AIの潮流が今、大きく変わり始めているということです。「より大きく高価なモデル」ではなく「より賢く効率的なモデル」を追求する動きが加速しています[16]。これはAIの民主化・持続可能性の観点からも望ましい方向でしょう。もちろんLLMが不要になるわけではなく、今後はLLMとSLMが棲み分けつつ共存する形になると考えられます[35]。汎用的な推論や高度な創造力が要る場面ではLLMが力を発揮し、そうでない多くの場面は軽量なSLMが支えるという構図です[32]。実際、次世代のインテリジェント企業インフラの中核はSLMになるとの予測もあり[16]、「大きいほど良い」から「小さい方が賢い」へのパラダイムシフトが今まさに起ころうとしています。日本においてもこの波を捉え、SLMを積極活用・開発することで、新たなAIビジネス創出や競争力強化に繋げていけるでしょう。SLMの時代は、すぐそこまで来ています。

参考文献・情報源(一部):

- 【1】Eliza, “The Looming Stagnation in LLM Technologies: Why Investors Should Exercise Caution”, Medium, Feb. 26, 2025[1][2].

- 【4】R. Tarafdar, “Scaling Intelligence: Overcoming Infrastructure Challenges in Large Language Model Operations”, Towards AI, Apr. 26, 2025[3][6][71][9].

- 【6】F. Wang et al., “A Survey of Small Language Models in the Era of LLMs”, Hugging Face, Jul. 16, 2025[5][14][12][18].

- 【8】Microsoft Research, “Phi-2: The surprising power of small language models”, Nov. 2023[54].

- 【11】M. Pise, “Understanding Low-Rank Adaptation (LoRA) in Fine Tuning LLM”, Medium, 2023[24].

- 【16】J. Johnson, “Small Language Models (SLM): A Comprehensive Overview”, Hugging Face, Feb. 22, 2025[17][15].

- 【18】A. Ganesh, “Why Specialized, Small Language Models (SLMs) are Outperforming General-Purpose LLMs”, OneReach.ai Blog, Sep. 4, 2025[41].

- 【19】NVIDIA, “How Small Language Models Are Key to Scalable Agentic AI”, Aug. 2025[31][36][32].

- 【24】Mistral AI Team, “Announcing Mistral 7B”, Sep. 27, 2023[59].

- 【26】R. D. Caballar, “What is Google Gemma?”, IBM Think Blog, Nov. 8, 2024[62][63].

- 【28】三宅陽一郎, コメント, Business+IT, 2024[48].

- 【29】Sakana AI, 「新手法TAIDを用いた小規模日本語言語モデルTinySwallow-1.5Bの公開」, 2025[20][21][50].

- 【30】HuggingFace Discuss/Reddit, 2024[39][68].

- 【32】アイノト, 「小規模言語モデル(SLM)とは?活用シーンから導入メリットまで」, note, 2025[42][29].

[1] [2] The Looming Stagnation in LLM Technologies: Why Investors Should Exercise Caution | Medium

[3] [4] [6] [7] [8] [9] [71] Scaling Intelligence: Overcoming Infrastructure Challenges in Large Language Model Operations | Towards AI

[5] [10] [11] [12] [13] [14] [18] [22] [27] A Survey of Small Language Models in the Era of LLMs: Techniques, Enhancements, Applications, Collaboration with LLMs, and Trustworthiness

[15] [17] [19] [37] Small Language Models (SLM): A Comprehensive Overview

[16] [40] The Case for Using Small Language Models

[20] [21] [49] [50] [52] [65] [66] 新手法「TAID」を用いた小規模日本語言語モデル「TinySwallow-1.5B」の公開

[23] [24] [25] [26] Understanding Low-Rank Adaptation (LoRA) in Fine Tuning LLM | by Mangesh Pise | Medium

[28] [29] [30] [38] [42] [43] [44] [45] [46] 小規模言語モデル(SLM)とは? 活用シーンから導入メリットまで|アイノト

[31] [32] [33] [34] [35] [36] How Small Language Models Are Key to Scalable Agentic AI | NVIDIA Technical Blog

[39] Smallest llama.cpp model : r/LocalLLaMA – Reddit

[41] Why Specialized SLMs are Outperforming General-Purpose LLMs?

[47] [53] エージェントAIの未来は小規模言語モデル(SLM)」と提言 LLM …

[48] 小規模言語モデル(SLM)とは? マイクロソフトPhi-3やグーグルGammaは何を競うのか? |ビジネス+IT

[51] 142億パラメータを持つ日本語に特化した視覚言語モデル

[54] [55] [56] [57] Phi-2: The surprising power of small language models – Microsoft Research

[58] [59] [60] [61] Mistral 7B | Mistral AI

[62] [63] [64] [67] What Is Google Gemma? | IBM

[68] ggml-org/llama.cpp: LLM inference in C/C++ – GitHub

[69] Llama.cpp | 🦜️ LangChain

[70] How to Implement Hugging Face Models using Langchain?