エグゼクティブサマリー

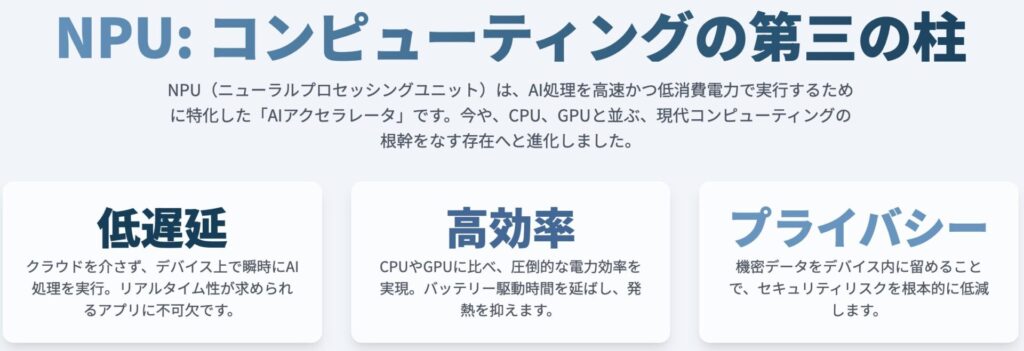

本レポートは、現代のコンピューティングアーキテクチャにおける中心的要素として急速に台頭しているニューラルプロセッシングユニット(NPU)について、その技術的基盤、市場動向、および戦略的意義を包括的に分析するものである。NPUは、特にAIの「推論」処理を高速かつ効率的に実行するために設計された専用プロセッサ、すなわち「AIアクセラレータ」として定義される 1。その役割は、汎用的なタスクを担うCPUや、主にグラフィックス処理およびAIの「学習」に用いられるGPUとは明確に区別される。

NPUの最大の戦略的価値は、その卓越した電力効率にある。この特性により、従来はクラウドサーバーに依存していたAI処理を、スマートフォンやPCなどのデバイス上で直接実行する「オンデバイスAI」または「エッジAI」という大きな技術シフトが加速している 3。オンデバイスAIは、低遅延、プライバシー保護、オフラインでの利用可能性といった、クラウドAIでは実現が困難だった利点を提供する。

このシフトを背景に、半導体業界では熾烈な競争が繰り広げられている。Apple、Qualcomm、Intel、AMDといった主要企業は、それぞれのSoC(System-on-a-Chip)に高性能なNPUを統合し、「AI PC」や「Copilot+ PC」といった新しいデバイスカテゴリの主導権を争っている 5。この競争は、単なる性能指標(TOPS)の追求に留まらず、ハードウェアとソフトウェアをいかに効果的に統合し、優れたユーザー体験を創出するかにかかっている。

しかし、各社が独自の開発環境を提供しているため、ソフトウェア開発の断片化という課題も浮上している。この問題を解決するため、MicrosoftのDirectMLのような抽象化レイヤーが、多様なハードウェア上で一貫したAI体験を提供するための鍵となっている 8。

結論として、NPUはもはや単なる補助的なコンポーネントではなく、AIが社会のあらゆる側面に浸透する現代において、コンピューティングアーキテクチャの根幹をなす第三の柱へと進化を遂げた。本レポートは、この重要な技術変革の全貌を解き明かすものである。

第1章 NPUのアーキテクチャ基盤

1.1. NPUの定義:AIファースト時代のための特殊プロセッサ

NPU(Neural Processing Unit)は、「AIプロセッサ」または「AIアクセラレータ」とも称される、人工知能(AI)および機械学習(ML)のワークロードを高速化するために特化して設計されたマイクロプロセッサである 1。その主要な機能は、ディープラーニングの基盤となる人工ニューラルネットワークが必要とする計算処理を実行することにある 11。

汎用的なCPUやグラフィックス処理に重点を置くGPUとは異なり、NPUは専門家である。特に、事前に学習されたモデルを用いて予測や意思決定を行うAIの「推論(inference)」段階に最適化されている 2。NPUの登場は、AIアプリケーションの計算要求が増大し、特にスマートフォンやノートPCのような電力に制約のある環境において、従来のCPUやGPUの能力が限界に達し始めたことへの直接的な応答であった 1。

1.2. NPUの仕組み:ニューラルネットワークをシリコン上で模倣する

NPUの核心的な概念は、人間の脳の神経回路網(ニューラルネットワーク)の構造と機能をハードウェアレベルで模倣することにある 10。仮想的なニューロン群の処理に相当する命令を実行できるように設計されており、これにより大規模な並列処理が可能となる 10。

AI、特にディープラーニングは、行列乗算や畳み込み演算といった特定の数学的演算に大きく依存している 13。NPUは、これらの特定の計算を極めて高速かつ効率的に実行するために明示的に設計された専用のハードウェアブロック(例:行列乗算ユニットやニューラルコンピュートエンジン)を内蔵している 20。これは、汎用CPUがこのようなタスクをはるかに非効率的に処理する点との重要な差別化要因である 12。

NPUのアーキテクチャにおける決定的な選択の一つが、8ビット整数(INT8)や16ビット浮動小数点数(FP16)、さらにはそれ以下の低精度演算の採用である 2。AIモデルの「学習」にはしばしば高精度(FP32など)が求められるが、「推論」は通常、精度を大幅に損なうことなく低精度で実行できる 4。これにより、NPUは単位電力および単位シリコン面積あたりでより多くの演算を実行でき、電力効率にとって極めて重要な要素となっている 3。

さらに、NPUは数千もの単純で特殊なプロセッシングエレメント(PE)をアレイ状に配置した、高度に並列化されたアーキテクチャを特徴とする 13。この設計はしばしばシストリックアレイと呼ばれ、データの流れ(データフロー)を最適化し、従来のアーキテクチャにおける電力消費と遅延の主要因であるメモリアクセスを最小限に抑える 4。アーキテクチャは、高速なオンチップメモリ(SRAM)と演算ユニット間のデータ移動を効率化し、より低速なシステムDRAMへの依存を減らすことを優先している 4。このアーキテクチャとアルゴリズムの深い共生関係こそが、NPUが持つ驚異的な効率性の源泉である。AIモデルはニューラルネットワークに基づいており、その計算は本質的に大規模な行列演算である。NPUは、この計算を直接実行するハードウェアを備えているため、汎用プロセッサで発生する非効率な「変換レイヤー」を回避できる。

1.3. 性能の測定:TOPS(Tera Operations Per Second)の役割と限界

TOPS(Tera Operations per Second)は、NPUの純粋な計算能力を定量化するための標準的な業界指標となっており、1秒間に1兆回の演算を意味する 14。すべての主要ベンダーがこの指標を用いて自社チップの性能を宣伝しており、現代のPCやスマートフォンのNPUは数十TOPS(例:Apple M4が38 TOPS、AMD Ryzen AI 300が50 TOPS)、次世代の車載チップは数千TOPS(NVIDIA DRIVE Thor)を目標としている 14。

しかし、TOPSは単独で見ると不完全で、誤解を招く可能性のある指標である。演算の種類(例:INT8対FP16)、メモリサブシステムの効率、コンパイラの有効性、あるいはシステム全体のアーキテクチャを考慮に入れていない 2。高いTOPS値も、低速なメモリによってボトルネックが生じ、実世界での性能が低下する可能性がある 27。したがって、TOPSは基本的な比較には有用であるが、デバイスのAI能力を判断する唯一の決定要因とすべきではない。NPUの真の戦略的優位性は、特にモバイルやエッジデバイスにおいて、生の速度以上に、その卓越したワットパフォーマンスにある。これは、低精度演算(「十分な」作業のみを行う)とデータフローアーキテクチャ(コストのかかるデータ移動を最小化する)という専門化によって達成されるものであり、バッテリー駆動時間や熱設計が厳しい制約となるデバイスで持続的なAIワークロードを可能にする「キラーフィーチャー」と言える 3。

第2章 新たなコンピューティングの三頭体制:CPU、GPU、NPUの比較分析

AI時代の到来は、コンピューティングの役割分担を根本的に変えた。もはや単一のプロセッサが全てのタスクを担うのではなく、CPU、GPU、NPUがそれぞれの得意分野を活かして協調する「三頭体制」が新たな標準となりつつある。このセクションでは、それぞれのプロセッサの役割と特性を比較分析する。

2.1. CPU(中央演算処理装置):万能な指揮者

CPUはコンピュータの「頭脳」であり、多様性と逐次的なタスク実行のために設計された汎用プロセッサである 11。そのアーキテクチャは、複雑で多様な命令を処理し、システム全体を管理するために設計された、少数の強力で高クロックなコアで構成されている 11。シングルスレッド性能とタスク切り替えに優れている。しかし、その逐次的な性質は、AIモデルが必要とする大規模な並列計算には非効率であり、性能低下や高いCPU負荷を引き起こし、システム全体の応答性を損なう可能性がある 11。

2.2. GPU(グラフィックスプロセッシングユニット):AI学習を担う並列処理の巨人

元々はグラフィックスのレンダリング用に設計されたGPUのアーキテクチャは、大規模な並列計算を伴うあらゆるタスクに理想的である 30。数百から数千のより単純なコアを内蔵し、大規模なデータセットに対して同じ操作を同時に実行できる 12。この特性により、膨大なデータをモデルに繰り返し通す必要があるディープラーニングの「学習」段階に非常に適している。しかし、AIの「推論」においては、その主な欠点が顕在化する。GPUは非常に高い電力を消費するため、バッテリー駆動のデバイスで継続的かつ低電力のAI推論を行うには不向きである 3。非常に高速に推論を実行できるが、それは大きなエネルギーコストを伴う。

2.3. NPU(ニューラルプロセッシングユニット):AI推論に特化した効率的な専門家

NPUは、AI推論のために専用設計されたプロセッサであり、ニューラルネットワークの演算を最大の速度と最小の消費電力で実行することを目的としている 1。第1章で詳述したように、大規模な並列処理、低精度演算、データフロー中心の設計を用いることで、AIタスクにおいてCPUとGPUの両方を上回る電力効率を達成する 3。これにより、オンデバイスでのリアルタイムアプリケーション(画像認識、音声アシスタント、ビデオ通話の背景エフェクトなど)に最適な選択肢となる 10。具体的な比較例として、ある画像認識タスクにおいて、NPUが0.2Wの電力しか消費しないのに対し、GPUは1.5W、CPUは2Wを要したという報告もある 12。

2.4. ヘテロジニアス・コンピューティング:現代のワークロードに対応する協調型アーキテクチャ

NPUはCPUやGPUを置き換えるものではなく、ヘテロジニアス・コンピューティング(異種混合計算)アーキテクチャにおいてそれらを補完するように設計されている 10。現代のSoCでは、タスクは最も適したプロセッサに動的に割り当てられる。CPUは逐次的な制御とシステム管理を、GPUはグラフィックスと高負荷な並列タスクを、そしてNPUは持続的なAIワークロードを担当する 5。この協調的アプローチは、しばしば中央の「AIエンジン」(Qualcommの製品など)によって管理され、適切なツールを適切な仕事に用いることで、システム全体の性能、熱効率、バッテリー寿命を最適化する 5。AIタスクをNPUにオフロードすることで、CPUとGPUが解放され、他のタスクを遅延なく実行できるようになる 1。

このプロセッサの専門化は、AIという新しい、しかし支配的なワークロードクラスに対して、性能と電力のバランスを取るために第三のプロセッサタイプが不可欠であるという業界の認識を示している。未来のシステム設計の焦点は、どのプロセッサが「勝つ」かではなく、それらがどのように連携して機能するかにある。最も効果的なシステムは、CPU、GPU、NPUにまたがるワークロードをインテリジェントかつシームレスに編成できるシステムとなるだろう。

表1:CPU、GPU、NPUの主要メトリクスにおける比較分析

| プロセッサタイプ | 主要機能 | アーキテクチャ設計 | コアのタイプ | 代表的な精度 | 電力効率 | 理想的なワークロード |

| CPU | 汎用逐次処理 | 少数、強力、複雑 | 複雑な命令セット | 高(FP32/FP64) | 中〜高 | OS、アプリケーション、制御ロジック |

| GPU | 並列処理 | 数千、単純 | 単純な並列演算 | 高(FP32)、一部低精度対応 | 非常に高い | グラフィックス、AIモデル学習、HPC |

| NPU | AI推論 | 数千、高度に専門化 | 行列・ベクトル演算 | 低(INT8/FP16) | 非常に低い | オンデバイスAI、リアルタイム推論、CV |

出典:3に基づく分析

第3章 オンデバイスAI革命

NPUの登場は、単なる新しいハードウェアの追加に留まらない。それは、コンピューティングのパラダイムをクラウド中心からデバイス中心へと移行させる「オンデバイスAI革命」の原動力である。この革命は、ユーザー体験とアプリケーション開発のあり方を根本から変えつつある。

3.1. エッジプロセッシングの論理的根拠:遅延、プライバシー、電力

AIタスクをデバイス上でローカルに処理する(「エッジ」で処理する)ことには、明確な利点が存在する。

- 遅延(Latency): クラウドサーバーへの往復時間をなくすことで、リアルタイム性が極めて重要となるアプリケーション(自動運転、ライブ翻訳、インタラクティブなカメラ効果など)において、致命的な遅延を回避できる 3。

- プライバシーとセキュリティ: 顔認証のための生体情報や翻訳のための個人的な会話といった機密データをデバイス内に留めることで、クラウドでのデータ漏洩リスクを根本的に軽減できる 4。

- 電力とコスト: 常にデータをクラウドに送受信することは、ネットワーク帯域とバッテリーを大量に消費する。効率的なNPUによるオンデバイス処理は、より省エネルギーであり、オフラインでも機能するため、AI機能をより堅牢でアクセスしやすくする 3。

- パーソナライゼーション: オンデバイスAIは、ユーザーのプライバシーを侵害することなく、個々の行動から学習することが可能なため、より深いカスタマイズとパーソナライズを実現する 4。

3.2. 「AI PC」と「Copilot+ PC」の誕生

「AI PC」とは、CPUとGPUに加えてNPUを搭載したパーソナルコンピュータを指す、技術的かつマーケティング的な用語である 3。Microsoftはこの概念を「Copilot+ PC」仕様で公式化した。この仕様は、NPUに最低40 TOPSの性能を求め、キーボードに専用のCopilotキーを搭載することを要件としている 25。

これらのPCは、Windowsやサードパーティ製アプリケーションの次世代AI機能(リアルタイム翻訳、高度なWindows Studio Effects、ユーザー活動を検索する「Recall」機能など)をローカルで実行するように設計されている 4。IntelのCore UltraプロセッサファミリーはAI PCへの初期のステップであったが、そのNPU性能(約10 TOPS)はCopilot+ PCの要件を満たしておらず、性能要求が急速に高まっていることを示している 28。この動きは、PCプラットフォームが単なるCPU速度やGPU性能だけでなく、AI推論能力という第三の性能軸を正式に導入したことを意味し、業界全体の戦略的な再編成を促している。

3.3. ユーザー体験とアプリケーション開発への影響

ユーザーにとって、NPUはAIアシスタントがより高速で応答性が高く、OSやアプリケーションに深く統合された未来を約束する 37。AI機能は、独立したクラウドベースのツールではなく、瞬時に利用できるネイティブなコンピューティング体験の一部のように感じられるようになるだろう。

開発者にとって、NPUの普及は、クラウドAPIに頼ることなく、強力なリアルタイムAI機能をアプリケーションに直接組み込む新たな機会を創出する。しかし、それは同時に、第6章で詳述するような、断片化したハードウェアエコシステム向けに開発するという課題ももたらす 36。AIの優位性を巡る戦いの舞台は、クラウドからエッジへと移りつつある。最高のオンデバイスAI体験(最も速く、シームレスで、有用な体験)を提供できる企業が、PCおよびスマートフォン市場で大きな競争優位性を獲得するだろう。これが、Qualcomm、Apple、AMD、Intel間の「TOPS戦争」の背景にある 14。

第4章 競争エコシステム:NPUプラットフォームの詳細分析

NPUの普及は、半導体業界のあらゆるセグメントで激しい競争を引き起こしている。PCやモバイルデバイスから、自動車、データセンターに至るまで、各社は独自の戦略とアーキテクチャで覇権を争っている。

4.1. PCおよびモバイルデバイスを巡る戦い

この分野の競争は、性能、電力効率、そしてエコシステムの統合力を巡って展開されている。

- AppleのNeural Engine:垂直統合の教訓

Appleは、2017年のA11 Bionicチップに最初のNeural Engineを導入し、Face IDのような機能を実現したオンデバイスAIの先駆者である 4。ハードウェア(Apple Silicon)、OS(iOS/macOS)、主要アプリケーションを自社で管理することで、Appleは「テキスト認識表示」や「画像を調べる」といった機能でNeural Engineを効果的に活用する、緊密に統合されたエコシステムを構築した 24。最新のM4チップは38 TOPSのNeural Engineを誇り、現在のどのAI PCのNPUよりも強力であると主張している 24。この長年の投資と垂直統合は、ハードウェアとソフトウェアを共に最適化する上で大きな競争優位性をもたらしている 5。 - QualcommのHexagon NPU:モバイルからCopilot+ PCへ

Qualcommは長年、Snapdragon SoCにHexagonプロセッサ(後に専用NPUを統合)を組み込み、モバイルAIタスクを支えてきた 5。Snapdragon X EliteおよびX Plusにより、同社はPC市場へ本格的に進出し、MicrosoftのCopilot+ PCイニシアチブのローンチパートナーとなった 6。これらのチップに搭載されたHexagon NPUは45 TOPSを実現し、Microsoftの要件を上回り、Windows on Armエコシステムのリーダーとしての地位を確立している。モバイル分野で培った電力効率の高いSoC設計の深い経験が、重要な資産となっている 5。 - IntelのCore Ultra:NPUをメインストリームへ統合

Intelは、Core Ultraプロセッサファミリー(コードネーム:Meteor Lake)で初の統合NPU(当初はVPUと呼ばれた)を導入した 2。これはIntelにとって大きなアーキテクチャの転換点であり、AI処理のための3層エンジン(CPU、GPU、NPU)を構築した 33。第一世代NPUの性能(約10 TOPS)は「Copilot+ PC」仕様には満たなかったものの、オンデバイスAIへのコミットメントを示し、将来の世代(例:Lunar Lake)ではるかに競争力のある製品を投入する基盤を築いた。Intelは開発者の採用を促すため、OpenVINOツールキットを推進している 28。 - AMDのRyzen AI:手ごわい挑戦者

AMDは、XilinxのXDNAアーキテクチャをベースにした初のNPUをRyzenプロセッサに統合し、「Ryzen AI」としてブランド化した 48。最新のRyzen AI 300シリーズは、最大50 TOPSのNPU性能を提供し、Copilot+ PC分野における直接の競合相手となっている 7。AMDは、PC市場での強力な地位、高性能な「Zen 5」CPUコア、RDNAグラフィックスを活用し、Lenovo、HP、ASUSなどの主要OEMから魅力的なAI PCプラットフォームを提供している 7。

表2:主要なコンシューマ向けSoCのNPU仕様

| ベンダー | SoC名 | NPUブランド | 公称NPU TOPS | 代表的な製品 |

| Apple | M4 | Neural Engine | 38 | iPad Pro (2024) |

| Qualcomm | Snapdragon X Elite | Hexagon NPU | 45 | Microsoft Surface Laptop 7, Dell Inspiron 14 Plus |

| AMD | Ryzen AI 9 365 | Ryzen AI (XDNA 2) | 50 | ASUS Zenbook, HP OmniBook |

| Intel | Core Ultra 7 155H | AI Boost | 約10 | Lenovo IdeaPad Pro 5i |

出典:5に基づく分析

4.2. 自動車分野におけるハイステークスな競争

自動車分野は、AIシリコンにとっての次なる巨大なフロンティアである。自動運転の処理要件はコンシューマデバイスを桁違いに上回り、高性能で安全性が重要なSoCの巨大市場を創出している。

- NVIDIA DRIVE Thor:ソフトウェア定義型自動車のためのスーパーコンピュータ

NVIDIAは、データセンターでの優位性を活かし、自動車向けの中央集権型「スーパーチップ」を開発している。DRIVE Thorは、ADAS、インフォテインメント、ドライバーモニタリングなど多数の機能を単一プラットフォームに統合するために設計された次世代SoCである 51。2,000 TFLOPS(2,000,000 TOPS)という驚異的な性能を誇り、次世代GPU(Blackwell)とCPU(Grace)技術を統合している。この性能レベルは、レベル4/5の自動運転を可能にすることを目的としている 26。ZEEKRやXPENGなどの自動車メーカーが2025年モデルに採用を表明している 51。 - Mobileye EyeQ:視覚中心のADASアプローチ

Mobileye(Intelの子会社)は、視覚ベースのADASにおける長年のリーダーであり、そのEyeQチップは50社以上の自動車メーカーの数百万台の車両に搭載されている 54。同社の戦略は、低電力・低コストで堅牢なADAS(L2/L2+)機能を提供する、高効率な専用SoCに焦点を当てている。EyeQファミリーは、基本的なADAS(EyeQ4)からプレミアムな「アイズオフ」システム(EyeQ6)までスケールする 54。 - Renesas R-Car:広範な自動車エコシステムの実現

ルネサス エレクトロニクスは、自動車向けマイコンおよびSoCの主要サプライヤーであり、R-Carプラットフォームはインフォテインメントから高度なADASまで幅広いアプリケーションを対象としている 57。R-Car V4HおよびV3U SoCは最大60 TOPSのディープラーニング性能を提供し、機能安全(ASIL B/D)と統合に重点を置いて設計されている 57。同社はまた、UCIe標準を介して外部NPUチップレットを統合できるチップレットベースの設計(R-Car X5シリーズ)にも目を向けている 59。

4.3. クラウドにおけるAIアクセラレーション:データセンターの対応物

- GoogleのTensor Processing Unit (TPU): カスタムAI ASICの先駆者であるGoogleは、自社のデータセンター内の内部ワークロード(検索、フォト、翻訳)を高速化するためにTPUを開発した 60。TPUはTensorFlowで多用される行列演算に高度に最適化されており、現在はGoogle Cloudを通じて一般にも提供されている 60。

- AWSのカスタムシリコン (InferentiaとTrainium): Amazon Web Servicesは、2つのカスタムAIチップファミリーを開発した。Trainiumは高性能でコスト効率の高いモデル「学習」専用であり、Inferentiaは低コストで高スループットのモデル「推論」に最適化されている 63。これらのチップはEC2インスタンス(Trn1/Trn2, Inf1/Inf2)を駆動し、AWS Neuron SDKと統合されている 65。

NPU市場は単一ではなく、コンシューマ、自動車、データセンターという、それぞれ異なる設計制約と目標を持つ専門化された戦場であることがわかる。コンシューマ市場では電力効率とコストが、自動車市場では機能安全と性能が、データセンター市場では大規模なTCO(総所有コスト)が最優先される。この多様性が、各社の異なる戦略を生み出している。

第5章 実世界のアプリケーションとその影響

NPUは、単なる技術仕様の向上に留まらず、ユーザーが日常的に接するテクノロジーとの関わり方を根本的に変革する力を持っている。その影響は、PCの操作から自動車の安全性まで、多岐にわたる。

5.1. ユーザーインターフェースの変革:リアルタイムの画像・音声・言語処理

NPUは、コンシューマデバイスにおける多くの現代的な「魔法のような」機能を実現する基盤技術である。

- 画像認識: 顔認証によるロック解除、写真内の物体検出、写真の自動分類、リアルタイムのカメラ効果(ポートレートモードなど)はすべてNPUによって高速化されている 13。プロフェッショナルな応用例では、NPUはワンタップで4Kビデオの背景から被写体を分離することができる 24。

- 音声認識・処理: 高速で正確なオンデバイス音声アシスタント、リアルタイム文字起こし、ノイズキャンセリング(Voice Focusなど)は、NPUが音声ストリームをローカルで効率的に処理することに依存している 3。

- 自然言語処理(NLP): オンデバイスNPUは、リアルタイム翻訳や文書の要約といったタスクを、データをクラウドに送信することなく処理できるため、速度とプライバシーが向上する 13。

これらの機能は、NPUがなければ実現不可能か、あるいは遅延が大きく実用的ではなかっただろう。NPUがもたらす最も成功した応用例は、ユーザーがその存在を意識することすらないものである。それらはデバイスの基本機能にシームレスに統合され、デバイスを単に「より賢く」、より直感的にしている。この「不可視性」は、技術が成熟した証であり、焦点が技術そのものから、それが可能にするユーザーの利益へと移っていることを示している。

5.2. ケーススタディ:Windows Studio EffectsはいかにNPUを活用してコミュニケーションを強化するか

Windows Studio Effectsは、Windows 11に組み込まれたAI駆動のカメラおよびマイク機能群であり、互換性のあるNPUを搭載したデバイス上で動作するように特別に設計されている 69。

- 機能: このスイートには、背景ぼかし(標準およびポートレート)、アイコンタクト(ユーザーの視線を調整してカメラを見ているように見せる)、自動フレーミング(ユーザーを常にフレームの中央に保つ)、音声フォーカス(背景ノイズを除去する)などが含まれる 68。

- NPUへの依存: これらの効果はNPUにオフロードされ、CPUとGPUの負荷を大幅に軽減する。これにより、ビデオ通話がスムーズに保たれ、システムのパフォーマンスが低下せず、同時にバッテリー寿命も節約される。これはハイブリッドワークにおいて極めて重要な利点である 68。

- 段階的な機能提供: Microsoftは段階的なシステムを導入している。基本的な効果は対応NPUを搭載したどのPCでも動作するが、ポートレートライトやテレプロンプターアイコンタクトのようなより高度な機能は、40 TOPS以上の性能を持つ強力なNPUを必要とする 70。これは、Copilot+ PCの明確な価値提案を生み出している。このアプローチは、ソフトウェア機能を利用してハードウェアのアップグレードサイクルを促進するという、洗練されたマーケティング戦略の典型例である。抽象的なスペック(GHzなど)から、具体的な利点(「テレプロンプターアイコンタクトが使える」)へと会話を移行させることで、消費者にハイエンドハードウェアを購入する明確な理由を提供している。

5.3. 自律システムの実現:ADASとロボティクスにおけるNPUの重要な役割

自動車分野において、NPUはADAS(先進運転支援システム)および自動運転システムの中核をなす。膨大なセンサーデータを処理して環境を認識し、物体を検出し、安全な進路を計画する 18。自動緊急ブレーキのような安全上重要な決定において、NPU処理の低遅延は譲れない要件である 55。

自動車以外にも、NPUはIoTデバイス、ロボティクス、産業オートメーションに不可欠である。これらの分野では、視覚検査、ナビゲーション、人間とロボットの協調といったタスクのために、リアルタイムで低電力のAIが必要とされる 10。

第6章 ソフトウェアの責務:断片化したハードウェア環境の統一

NPUという強力なハードウェアが普及する一方で、その能力を最大限に引き出すためのソフトウェアエコシステムは、大きな課題に直面している。ハードウェアの多様性が、開発の複雑化とイノベーションの阻害要因になりかねないからだ。

6.1. プロプライエタリAPIとベンダーロックインの課題

前述の通り、主要なNPUベンダー(Apple, Qualcomm, Intel, AMD)はそれぞれ、独自のソフトウェアスタックとAPI(例:CoreML, Snapdragon NPE, OpenVINO)を提供している 2。これはソフトウェア開発者にとって重大な課題を生む。最適なパフォーマンスを達成するためには、プラットフォームごとに個別のコードベースを記述・維持する必要があり、これはコストと複雑さを増大させる 36。この断片化はイノベーションのブレーキとして機能する。多くの開発者は、NPUを無視してCPUやGPU上でAIワークロードを実行することを選択するかもしれず、そうなればNPUの効率性の利点は実現されない 42。

6.2. 抽象化による解決策:Microsoft DirectMLとONNX Runtime

この問題を解決するため、業界標準の抽象化レイヤーが登場している。Windowsエコシステムで最も著名なのが、ONNX RuntimeとDirectMLの組み合わせである。

- ONNX (Open Neural Network Exchange): AIモデルを表現するためのオープンフォーマット。様々なフレームワーク(PyTorch, TensorFlow)で作成されたモデルをONNX形式に変換できる 8。

- ONNX Runtime: ONNXモデルを受け取り、「Execution Provider」と呼ばれる様々なハードウェアバックエンドで実行できる高性能な推論エンジン 75。

- DirectML (Direct Machine Learning): Microsoftが提供する、DirectX 12を基盤とした低レベルAPI。Windows上のハードウェア抽象化レイヤーとして機能し、ONNX Runtimeがベンダーに関係なく、互換性のあるGPUやNPUと対話するための単一のインターフェースを提供する 8。

このワークフローにより、開発者はベンダー固有のコードを書くことなく、自社のアプリケーションにAIアクセラレーションを組み込むことができる。AI PC戦争における最も重要な戦いは、シリコンではなくソフトウェアで戦われる可能性がある。最もシームレスで強力、かつ使いやすい開発環境を提供するベンダーやプラットフォームが、最終的に開発者の支持を得て、最も豊かなアプリケーションエコシステムを築くだろう。

6.3. 現状:ハードウェア能力とソフトウェア利用のギャップ

これらの抽象化レイヤーが有望であるにもかかわらず、依然として大きなギャップが存在する。多くの人気ローカルAIツールは、まだNPUを完全には、あるいは効果的に活用できていない 42。ソフトウェアエコシステムはまだ成熟過程にある。特定のNPUのユニークなアーキテクチャに対して、汎用的なAIモデルを効率的な命令に変換するためには、コンパイラとドライバが高度に最適化される必要がある 20。これは、ユーザーが強力な50 TOPSのNPUを持っていても、使用するアプリケーションがDirectMLのようなフレームワークを通じてそれを適切に活用するように更新されるまで、その恩恵を完全には受けられない可能性があることを意味する。

抽象化レイヤーは、ハードウェアベンダーにとって両刃の剣である。広範な採用を可能にする一方で、基盤となるハードウェアをコモディティ化させ、ベンダーが差別化を図ることを難しくするリスクも伴う。DirectMLのような抽象化レイヤーは、意図的に各NPUのユニークなアーキテクチャ詳細を開発者から隠蔽する 75。これにより、競争の基盤は「誰が最高のプロプライエタリAPIを持っているか」から「誰のハードウェアが標準API(DirectML)を最も速く、最も効率的に実行できるか」へと移行する。これは消費者にとっては良いことだが、自社の技術の周りに防御的な「堀」を築こうとするベンダーにとっては挑戦的である。

第7章 市場分析と将来の軌跡

NPUの台頭は、技術的な変革であると同時に、巨大な経済的機会を生み出している。市場予測は一様に急成長を示唆しており、NPUの設計思想もまた、次なる進化の段階へと向かっている。

7.1. オンデバイスAIおよびAI半導体市場の規模と成長予測

オンデバイスAI市場は、爆発的な成長が見込まれている。予測は調査会社によって異なるが、一貫して大規模な拡大を示している。

- ある予測では、オンデバイスAI市場は2025年の266.1億米ドルから、年平均成長率(CAGR)24.6%で成長し、2032年までに1240.7億米ドルに達するとされている 77。

- 別の予測では、2034年までに2512億米ドルに達すると見込まれている 78。

- より広範なAI半導体市場も急速な成長が予測されており、2024年の719.1億米ドルから、2033年には3216.6億米ドルに達する(CAGR 18.11%)と推定されている 79。

これらの数字は、NPUのようなAI特化型ハードウェアの普及によって引き起こされる、巨大な経済的シフトを裏付けている。この規模の成長は、単なる成功した製品カテゴリではなく、新しいコンピューティングパラダイムが定着しつつあることを示唆している。これは、今後10年以内に、高性能なNPUを搭載していないデバイスは、GPUを搭載していないPCやマルチコアCPUを搭載していないスマートフォンと同様に、時代遅れと見なされるようになることを意味する。

7.2. NPU設計の未来:チップレットとより深い統合へ

SoCがより複雑になるにつれて、単一のチップで全ての機能を設計・製造するモノリシックなアプローチは、ますます困難かつ高コストになっている。業界は、異なる機能(CPU, GPU, NPU, I/O)を別々の小さなチップ(「チップレット」)として製造し、それらを単一のパッケージに統合するチップレットベースの設計へと移行している。

このアプローチは、より大きな柔軟性とコスト効率を提供する。ルネサスは、自動車向けのR-Carシリーズでこのアプローチを明確に追求しており、標準的なUCIeインターコネクトを介して外部のNPUチップレットを追加することで、性能を拡張できるようにしている 59。この「構成可能な」未来は、ヘテロジニアス・コンピューティングの次なる論理的なステップであり、システム設計における「レゴブロック」のようなアプローチを可能にし、より大きなカスタマイズと迅速なイノベーションを促進する。

将来のNPUは、さらに専門化が進むだろう。NVIDIAのDRIVE Thorに搭載された、生成AIを駆動するトランスフォーマーモデルを高速化するために設計された「推論トランスフォーマーエンジン」のように、特定のモデルタイプに特化した専用エンジンが既に登場している 51。IntelのLunar Lake NPUも、トランスフォーマーネットワークを高速化するために特化して進化している 47。

7.3. 戦略的展望と業界関係者への提言

- ハードウェアベンダー: 焦点は、ワットパフォーマンスと、DirectMLのような主要なソフトウェア抽象化レイヤーとのシームレスな統合に置かれなければならない。差別化は、単なる生のTOPSではなく、アーキテクチャの効率性から生まれる。

- ソフトウェア開発者: オンデバイスAIを受け入れるべきである。ONNX Runtimeのような抽象化レイヤーを活用し、ベンダー固有のコードに煩わされることなく、広範かつ成長中のNPU搭載デバイスのインストールベースをターゲットにすべきである。

- OEM(PCおよび自動車): ユーザー体験が主要な差別化要因となる。成功は、ハードウェアとソフトウェアをインテリジェントに統合し、仕様書を超えて実世界での価値あるAI駆動の利点をエンドユーザーに提供できるかどうかにかかっている。

- 投資家: オンデバイスAIおよびAI半導体市場は、著しい成長が見込まれる。注目すべき主要分野は、PC分野での競争力学、ハイステークスな自動車市場、そしてエコシステムを繋ぎ合わせる重要なソフトウェア「接着剤」を提供する企業である。

結論

NPUは、携帯電話向けのニッチなアクセラレータから、コンシューマ、自動車、データセンターといったあらゆるセクターにわたる現代のコンピューティングアーキテクチャの礎へと進化した。本レポートを通じて明らかになったのは、NPUの真の重要性がその生の速度(TOPS)にあるのではなく、その効率性にあり、それが遍在するオンデバイスAIの時代を切り開いたという点である。

垂直統合と水平エコシステムの間の戦略的緊張、ハードウェア能力とソフトウェア利用のギャップ、そして各市場セグメントにおける独自の競争力学は、この技術の進化を形作る重要な要素であり続けるだろう。

今後、NPUがさらに強力になり、ソフトウェアエコシステムが成熟するにつれて、AIは私たちのテクノロジーとの日常的な対話において、さらに深く、そして目に見えない形で組み込まれていくことになるだろう。この変革は、この小さく、専門化された、しかし極めて重要なシリコン片によって駆動されているのである。

引用文献

- NPU – IT用語集 – スマートワーク総研 https://swri.jp/glossary/NPU

- en.wikipedia.org https://en.wikipedia.org/wiki/Neural_processing_unit

- NPUとは?CPU・GPUとの違いやAI処理での必要性を解説 – mouse LABO – マウスコンピューター https://www.mouse-jp.co.jp/mouselabo/entry/2025/07/09/100206

- プロセッサコアの新たな主役「NPU」とは 手元の端末に高度なAIがある時代に – 東京エレクトロン https://www.tel.co.jp/museum/magazine/report/202411_01/

- NPUとは?AI処理に特化したプロセッサについて、近年の開発事例も紹介 – Rentec Insight https://go.orixrentec.jp/rentecinsight/it/article-416

- NPU:Qualcomm Hexagonのノートパソコン 比較 2025年人気売れ筋ランキング – 価格.com https://kakaku.com/pc/note-pc/itemlist.aspx?pdf_Spec108=20

- コスパ最強のRyzen AIとは?おすすめのノートパソコンも紹介|AI時代にふさわしい1台を選ぶならコレ – BTOゲーミングPCや https://btopicks.com/ryzen-ai-notepc/1348/

- Get started with DirectML | Microsoft Learn https://learn.microsoft.com/en-us/windows/ai/directml/dml-get-started

- DirectML https://microsoft.github.io/DirectML/

- What is a Neural Processing Unit (NPU)? – IBM https://www.ibm.com/think/topics/neural-processing-unit

- NPUとは?初心者向けに分かりやすく解説します | レノボ・ ジャパン – Lenovo https://www.lenovo.com/jp/ja/articletop/pc/npu/

- NPUとは?CPU・GPUとの違いを徹底解説!AI処理に特化したプロセッサの実力 https://www.blooktecpc-support.com/useful/what_is_npu/

- 最近良く聞くNPUについて調べてみた!って、AIに対応も大変だなぁ・・と思う今日この頃。 – note https://note.com/fair_lynx741/n/n8dc077f62558

- AI処理を高速化する「NPU」とは – ID インフォメーション・ディベロプメント https://www.idnet.co.jp/column/page_362.html

- NPUとは?その必要性やGPU・CPUとの違いをわかりやすく解説 https://www.ai-souken.com/article/what-is-npu

- All about neural processing units (NPUs) – Microsoft Support https://support.microsoft.com/en-us/windows/all-about-neural-processing-units-npus-e77a5637-7705-4915-96c8-0c6a975f9db4

- GPU, LPU and NPU: What are these architectures? – DataNorth AI https://datanorth.ai/blog/gpu-lpu-npu-architectures

- ニューラル処理ユニット(NPU)とは? |ピュア・ストレージ – Pure Storage https://www.purestorage.com/jp/knowledge/what-is-neural-processing-unit.html

- What Is a Neural Processing Unit (NPU)? – Pure Storage https://www.purestorage.com/knowledge/what-is-neural-processing-unit.html

- Quick overview of Intel’s Neural Processing Unit (NPU) https://intel.github.io/intel-npu-acceleration-library/npu.html

- Unlocking TPUs in Advanced Computer Architecture – Number Analytics https://www.numberanalytics.com/blog/ultimate-guide-to-tpus

- The hardware architecture of the neural processing engine. The left… | Download Scientific Diagram – ResearchGate https://www.researchgate.net/figure/The-hardware-architecture-of-the-neural-processing-engine-The-left-part-is-the-neural_fig4_336514386

- NPU vs GPU: What’s the Difference? – IBM https://www.ibm.com/think/topics/npu-vs-gpu

- Apple、M4チップを発表 https://www.apple.com/jp/newsroom/2024/05/apple-introduces-m4-chip/

- AMD Ryzen AI搭載のCopilot+ PC – iDATEN(韋駄天) https://www.idaten.ne.jp/portal/page/out/mss/hpi/elitebook_x_g1a.html

- Hardware for Self-Driving Cars – NVIDIA https://www.nvidia.com/en-sg/self-driving-cars/drive-platform/hardware/

- What is an NPU? A Penn expert explains – Penn Today – University of Pennsylvania https://penntoday.upenn.edu/what-is-an-NPU-in-computing

- IntelのNPUについて初心者向けに分かりやすく解説します | レノボ・ ジャパン – Lenovo https://www.lenovo.com/jp/ja/articletop/pc/intel-npu/

- Difference between CPU, GPU, TPU and NPU | by Abhishek Jain – Medium https://medium.com/@abhishekjainindore24/difference-between-cpu-gpu-tpu-and-npu-09fca09f0bb6

- PC選びの基本:CPU・GPU・NPUの役割と選び方のポイント https://www.yec.ne.jp/column/trivia/lcm_20241211

- CPU、GPU、NPU、TPUの特徴や違いについて解説 – Rentec Insight https://go.orixrentec.jp/rentecinsight/it/article-415

- CPU vs GPU vs NPU: What’s the difference? | CORSAIR https://www.corsair.com/us/en/explorer/diy-builder/power-supply-units/cpu-vs-gpu-vs-npu-whats-the-difference/

- NPUとCPU・GPUの違いは?NPU搭載AIパソコンを購入すべきか – GEEKOM(ギコム)ミニPC https://blog.geekom.jp/difference-between-npu-cpu-and-gpu/

- NPU vs GPU: Which Is Better for AI? – C&T Solution Inc. https://www.candtsolution.com/news_events-detail/NPU-vs-GPU-Which-Is-Better-for-AI/

- What is an NPU? And why is it key to unlocking on-device generative AI? – Qualcomm https://www.qualcomm.com/news/onq/2024/02/what-is-an-npu-and-why-is-it-key-to-unlocking-on-device-generative-ai

- CPU・GPU・NPU・ISP・SoCの役割と動向を軽く解説 – Qiita https://qiita.com/syun88/items/04f7bbdd88c05ac9000f

- NPUとCPU・GPUの違いとは?AIプロセッサ処理で何ができるようになるのか https://staff.persol-xtech.co.jp/hatalabo/it_engineer/707.html

- NPU(Nural Processing Unit)とは?AI PCを実現するプロセッサの特徴・CPUやGPUとの違い・メリットを解説! – AI Market https://ai-market.jp/ai_magazine/what-npu/

- Core UltraプロセッサーのNPU性能や特徴について解説します | レノボ・ ジャパン – Lenovo https://www.lenovo.com/jp/ja/articletop/pc/core-ultra-npu/

- TOPSが | Qualcomm https://www.qualcomm.com/content/dam/qcomm-martech/dm-assets/documents/WhatIsTops-OnePager-Japanese.pdf

- AIパソコンは何ができる?Copilot in Windowsやその他の活用事例を徹底解説 https://www.nec-lavie.jp/products/contents/ai-pc-what-can-do.html

- ローカルAIにGPUやNPUは本当に必要か?最新の考察|生成AI活用研究部 – note https://note.com/genaird/n/nbd06efb0bb30

- AppleのAI戦略の謎 ~ 「M3 Mac」は「iPhone 15 Pro」の半分のAI性能・Windowsとどう競争する? – Nishiki-Hub https://nishikiout.net/entry/2024/01/08/191858

- パーソナルAI「Apple Intelligence」の対応デバイスが“限られる”理由 | Mac Fan Portal https://macfan.book.mynavi.jp/article/6146/

- NPU:Qualcomm Hexagonのモバイルノート 比較 2025年人気売れ筋ランキング – 価格.com https://kakaku.com/pc/mobile-note/itemlist.aspx?pdf_Spec108=20

- インテルCore Ultra搭載 AIパソコン|ソフマップ[sofmap] https://www.sofmap.com/contents/?id=nw_pc_intel&sid=core_ultra

- Architecture All Access: Live at Lunar Lake ITT: NPU Architecture Deep Dive – YouTube https://www.youtube.com/watch?v=Ljao5xaZ-Es&pp=0gcJCfwAo7VqN5tD

- AMD RYZEN™ AIを搭載した新世代PCのご紹介 – ECNex https://www.ecnex.jp/connect/articles/5168

- AMD Ryzen™ AI ノートパソコン | Acer 日本 https://www.acer.com/jp-ja/amd-ryzen-series-laptops

- NPU:AMD Ryzen AIのノートパソコン 比較 2025年人気売れ筋ランキング – 価格.com https://kakaku.com/pc/note-pc/itemlist.aspx?pdf_Spec108=19

- NVIDIA Unveils DRIVE Thor — Centralized Car Computer Unifying Cluster, Infotainment, Automated Driving, and Parking in a Single, Cost-Saving System https://nvidianews.nvidia.com/news/nvidia-unveils-drive-thor-centralized-car-computer-unifying-cluster-infotainment-automated-driving-and-parking-in-a-single-cost-saving-system

- DRIVE Thor Unites AV and Cockpit on a Single SoC – NVIDIA Blog https://blogs.nvidia.com/blog/drive-thor/

- NVIDIA DRIVE Powers Next Generation of Transportation — From Cars and Trucks to Robotaxis and Autonomous Delivery Vehicles https://nvidianews.nvidia.com/news/nvidia-drive-powers-next-generation-transportation

- The Evolution of EyeQ – Mobileye https://www.mobileye.com/technology/eyeq-chip/

- Mobileye – Wikipedia https://en.wikipedia.org/wiki/Mobileye

- Mobileye at CES 2025 https://www.mobileye.com/ces-2025/

- R-Car Automotive System-on-Chips (SoCs) – Renesas https://www.renesas.com/en/products/automotive-products/automotive-system-chips-socs

- Best-in-Class R-Car V3U ASIL D System-on-Chip for Automated Driving | Renesas https://www.renesas.com/en/products/r-car-v3u

- Renesas Unveils Industry’s First Automotive Multi-Domain SoC Built with 3-nm Process Technology https://www.renesas.com/en/about/newsroom/renesas-unveils-industry-s-first-automotive-multi-domain-soc-built-3-nm-process-technology

- Tensor Processing Unit – Wikipedia https://en.wikipedia.org/wiki/Tensor_Processing_Unit

- Tensor Processing Unit : Architecture, Differences & Its Applications – ElProCus https://www.elprocus.com/tensor-processing-unit/

- Introduction to Cloud TPU – Google Cloud https://cloud.google.com/tpu/docs/intro-to-tpu

- AI Accelerator – AWS Trainium https://aws.amazon.com/ai/machine-learning/trainium/

- AWS Inferentia – AI Chip https://aws.amazon.com/ai/machine-learning/inferentia/

- aws-neuron (AWS Inferentia and Trainium) – Hugging Face https://huggingface.co/aws-neuron

- Ray Integration for AWS Trainium and AWS Inferentia is Now Available https://aws.amazon.com/blogs/opensource/ray-integration-for-aws-trainium-aws-inferentia-is-now-available/

- AI活用の新たな主役! NPUとは ~注目の理由と活用事例紹介~ | ウィズソフタス https://media.softas.co.jp/2024/11/13/ai%E6%B4%BB%E7%94%A8%E3%81%AE%E6%96%B0%E3%81%9F%E3%81%AA%E4%B8%BB%E5%BD%B9%EF%BC%81%E3%80%80npu%E3%81%A8%E3%81%AF-%EF%BD%9E%E6%B3%A8%E7%9B%AE%E3%81%AE%E7%90%86%E7%94%B1%E3%81%A8%E6%B4%BB%E7%94%A8/

- How to Identify AI-Enabled Windows Computers | Dell Ireland https://www.dell.com/support/kbdoc/en-ie/000223944/how-to-identify-ai-enabled-windows-computers

- Windows Studio Effects Overview | Microsoft Learn https://learn.microsoft.com/en-us/windows/ai/studio-effects/

- [How To] Install & Set Up Windows Studio Effect? – MSI https://us.msi.com/faq/faq-10695

- How to use Windows Studio effects on Windows 11 – XDA Developers https://www.xda-developers.com/how-use-windows-studio-effects/

- [Microsoft AI Feature] Windows Studio Effects Introduction | Official Support | ASUS USA https://www.asus.com/us/support/faq/1051543/

- Windows Studio Effects – Microsoft Support https://support.microsoft.com/en-us/windows/windows-studio-effects-273c1fa8-2b3f-41b1-a587-7cc7a24b62d8

- 韓国サムスンが自動運転車用半導体に本格参入 米アンバレラのSoCを5ナノ技術で生産 https://dempa-digital.com/article/409372

- DirectML Execution Provider – onnxruntime https://onnxruntime.ai/docs/execution-providers/DirectML-ExecutionProvider.html

- Get started with ONNX models in your WinUI app with ONNX Runtime – Microsoft Learn https://learn.microsoft.com/en-us/windows/ai/models/get-started-onnx-winui

- オンデバイスAI市場 トレンド、シェア、予測、2025-2032 – Coherent Market Insights https://www.coherentmarketinsights.com/ja/%E3%82%AA%E3%83%B3%E3%83%87%E3%83%90%E3%82%A4%E3%82%B9AI%E5%B8%82%E5%A0%B4

- オンデバイスAIの世界市場:市場規模・シェア・動向、業界分析 (コンポーネント別・展開方式別・技術別・デバイスの種類別・業種別・地域別)、将来予測 (2025年~2034年) – グローバルインフォメーション https://www.gii.co.jp/report/pola1762483-on-device-ai-market-size-share-industry-analysis.html

- 半導体市場における人工知能(AI)は2033年までに市場規模3216億6000万米ドルを超えると予測 | NEWSCAST https://newscast.jp/news/2819941