生成AIの進化がビジネスのあらゆる領域を再定義する中、ソフトウェア開発の現場で極めて重要なパラダイムシフトが起きています。本レポートでは、AIコーディング支援ツールのトップランナーである「Cursor(カーソル)」が、OpenAIやAnthropicといった巨大プロバイダーへの依存から脱却し、独自の特化型モデルへと舵を切った背景と、それが今後のエンタープライズAI市場に与える影響について解説します。

1. 汎用巨大モデル(LLM)への依存が抱える3つの限界

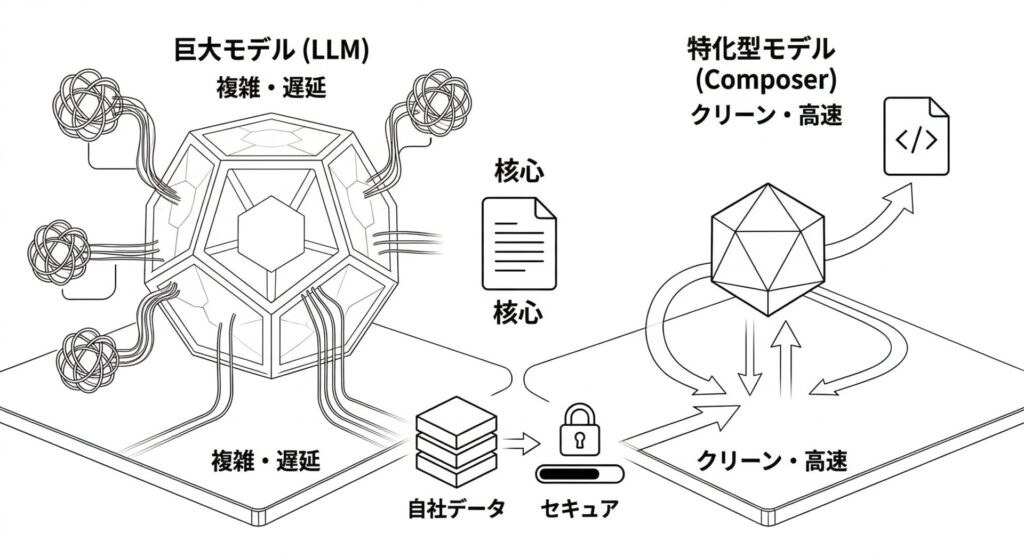

これまで多くのAIアプリケーションは、OpenAI(GPTシリーズ)やAnthropic(Claudeシリーズ)のAPIを裏側で呼び出すことで高度な機能を実現してきました。しかし、開発ツールとしてこれらに依存し続けることには、実務上の明確な限界がありました。

- コストとレスポンス遅延の壁: 「何でも答えられる」汎用モデルは計算処理が重く、APIの利用コストも膨大です。開発者が求める「思考を止めない数秒以内のレスポンス」を安定して提供するには、外部ネットワークを経由する遅延が大きなボトルネックとなっていました。

- インフラの脆弱性と制限リスク: プロバイダー側のサーバー混雑によるダウンや、利用制限(レートリミット)の発生は、ツールを利用する開発者の業務停止に直結します。

- 専門業務における計算資源の無駄: コードのバグを修正するタスクにおいて、「歴史の解説」や「詩の創作」ができる汎用的な知識は不要です。

Cursorはこれらの課題を根本から解決するため、自らの手で「スピード・コスト・安定性」をコントロールする独自モデルの内製化という戦略に打って出ました。

2. 独自モデル「Composer」の実態とオープンソースの融合

Cursorが新たに展開するモデル「Composer」は、ゼロから巨大なAIを構築したわけではありません。世界的な開発競争の中で生まれたオープンソースモデルの恩恵を最大限に活用しています。

- 強力なオープンソースを基盤に採用: 少ない計算資源で驚異的な推論能力を叩き出した「DeepSeek」や「Qwen」などの軽量かつ優秀なオープンソースモデルのアーキテクチャをベースに採用しています。

- ソフトウェア工学への完全特化: このベースモデルに対し、Cursorが持つ膨大なエディタ操作ログやコードの文脈データを用いて独自の強化学習を実施しました。これにより、単なるテキスト生成ではなく「複数ファイルを横断して修正する」「コマンドを実行してエラーを検証する」といったエージェント(自律実行型)としての振る舞いに特化させています。

- 圧倒的な処理スピード: 汎用モデルと比較して数倍の速度を誇り、実務における複雑な修正タスクの大部分を数十秒未満で完了させるレスポンスを実現しました。

3. Metaなど巨大企業が「特化型AI」を採用する理由

個人開発者から熱狂的な支持を集めてきたCursorですが、現在ではMetaやNVIDIAといったビッグテックとのエンタープライズ契約を次々と獲得しています。大企業がこの特化型モデルを評価する理由は明確です。

- セキュリティとデータガバナンス: サードパーティ(外部の汎用AIプロバイダー)のAPIに自社の機密コードを送信することを嫌うエンタープライズ企業にとって、コントロール可能な独立した特化型モデルは、厳しいセキュリティ審査を通過しやすいという大きな利点があります。

- 自社独自の文脈への最適化: 「一般的な知識を広く持つAI」よりも、「自社の巨大で複雑なレガシーコードの文脈を深く理解し、的確な差分を提案してくれるAI」の方が、開発組織の生産性を直接的に押し上げます。

- UIの深部まで統合された体験: 既存エディタの拡張機能(プラグイン)ではなく、エディタそのもの(IDE)を独自に構築しているため、AIが開発者の思考を妨げることなくシームレスに業務フローへ溶け込みます。

4. 今後のAI市場に与える影響と企業が取るべき戦略

Cursorの成功は、今後のエンタープライズAI市場における大きなトレンドの変化を示唆しています。

- 「巨大基盤モデル一強」時代の終焉: すべての業務を少数の汎用巨大AIが飲み込むのではなく、コーディング、医療、法務、財務といった特定の業務ドメインにおいては、「オープンソースをベースに独自データで磨き上げた特化型AI」が汎用AIを凌駕するフェーズに入りました。

- エージェント型UIの標準化: AIの役割は「チャットで質問に答えるアシスタント」から、「要件を伝えると、裏側で自律的にタスクを実行し、完了まで導く代行者」へと完全に進化しています。

企業への示唆:

今後のIT投資やシステム構築においては、「どの巨大AIを使うか」という単一の選択肢から脱却する必要があります。自社のコア業務においては、特定のタスクに特化し、自社データを安全に組み込める「特化型モデル(ローカルLLMや小規模言語モデル:SLM)」の採用を検討し、適材適所でAIを使い分けるハイブリッドな運用体制の構築が競争力の源泉となるでしょう。

参照情報・関連リンク

- Forbes (2026年3月5日)Cursor Goes To War For AI Coding Dominancehttps://www.forbes.com/sites/annatong/2026/03/05/cursor-goes-to-war-for-ai-coding-dominance/

- Cursor 公式サイトThe AI Code Editorhttps://cursor.com/